Whisper Large-v3 上线:更强多语言 ASR、细节优化与上手指南¶

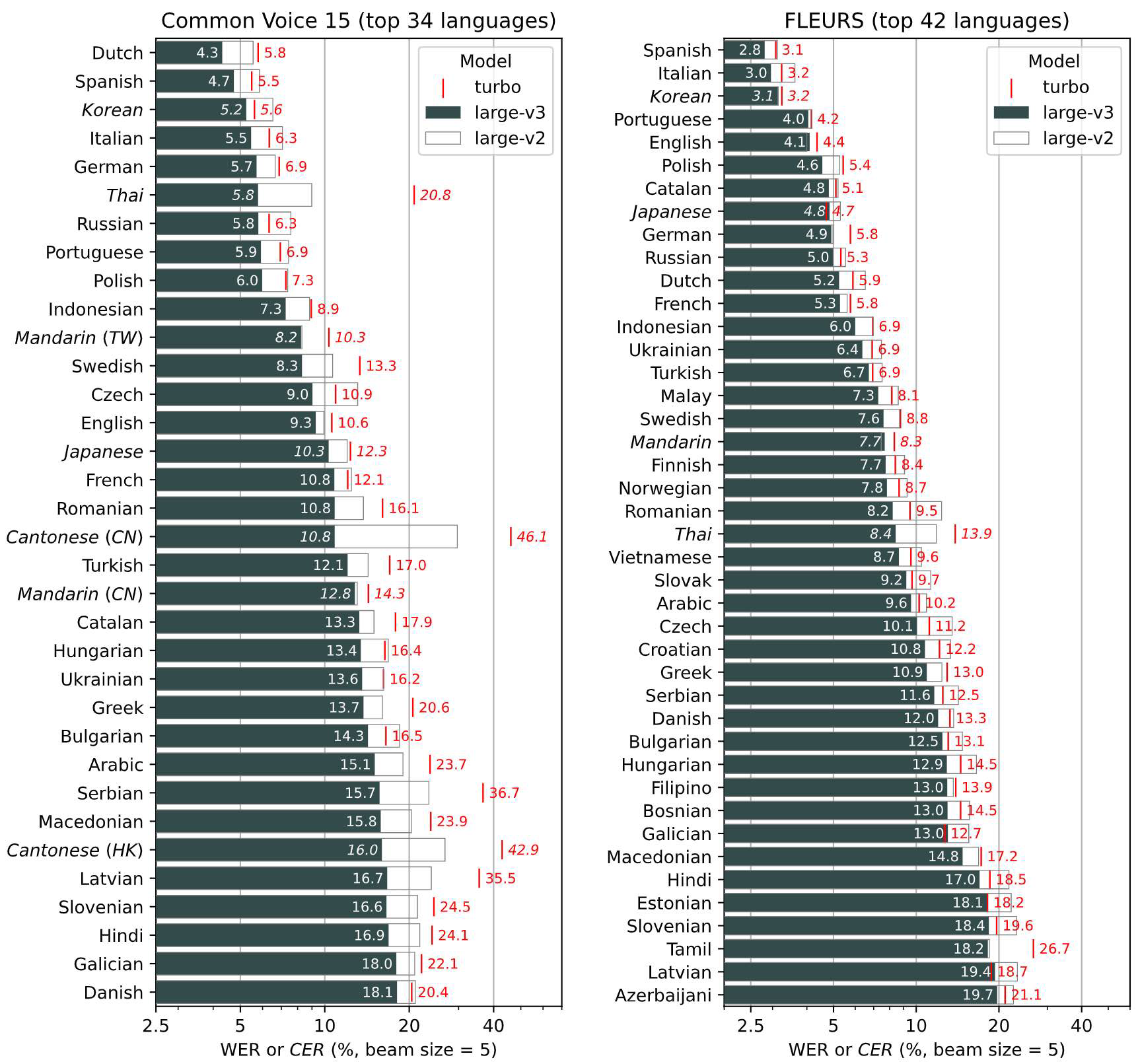

OpenAI 的最新开源语音识别与翻译模型 Whisper large-v3 已在 Hugging Face 发布。相较 large-v2,官方卡片给出的结论是在多种语言上将错误率再降 10–20%,并对模型与使用方式做了多处工程细节说明。

Whisper 是 OpenAI 在论文 Robust Speech Recognition via Large-Scale Weak Supervision(作者 Alec Radford 等人)中提出的一个先进的自动语音识别(ASR)与语音翻译模型。该模型基于超过 500 万小时标注数据进行训练,在零样本(zero-shot)场景下展现出了强大的跨数据集和跨领域的泛化能力。

Whisper large-v3-turbo 是对 Whisper large-v3 的裁剪版本进行微调(finetuned)得到的。在本质上,它与原模型完全一致,唯一的区别是 解码层(decoding layers)从 32 层减少到 4 层。因此,它能以更快的速度运行,但会牺牲少量的识别质量。更多细节可以在 GitHub 相关讨论中找到。

- 性能:多语言场景相对 large-v2 10–20% 错误率下降。

- 数据规模:基于 100 万小时弱标注 + 400 万小时伪标注(由 large-v2 生成)训练,共 2.0 个 epoch。

- 架构变化:仍为 Transformer 编解码器,但梅尔频带从 80 提升至 128,并加入粤语语言 token。

- 语言覆盖:支持 99 种语言;可做转写与英译。

- 许可:Apache-2.0,可商用。

¶

¶

v3 与 v2 的关键差异¶

- 输入表征更细:128 个梅尔滤波器替代 80 个,有助于捕捉更细的频谱信息;

- 语言标签更新:新增粤语 token,改善该语种入口;

- 训练侧升级:引入更大规模的伪标注混合数据,带来跨语言泛化的整体提升。上述变化共同支撑了“相对 v2 降错 10–20%”的结论。

何时选用 large-v3?¶

- 多语言/口音复杂的转写:对口音、噪声、术语更鲁棒;零样本英译表现稳定。

- 长音频处理:官方同时给出了顺序式与分块式两种长音频推理策略,可按准确率/时延权衡选择。

- 注意边界:该模型不适用于“推断人类属性”等分类用途;这类任务既未评测也不合适。

三步上手(Transformers)¶

Whisper large-v3-turbo 已在 Hugging Face 🤗 Transformers 中得到支持。要运行该模型,需要先安装 Transformers 库。在下面的示例中,我们还会安装:

- 🤗 Datasets(用于从 Hugging Face Hub 加载音频数据集)

-

🤗 Accelerate(用于加快模型加载速度)

-

安装依赖:

- 最短可运行示例(本地/URL 音频皆可):

import torch

from transformers import AutoModelForSpeechSeq2Seq, AutoProcessor, pipeline

device = "cuda:0" if torch.cuda.is_available() else "cpu"

dtype = torch.float16 if torch.cuda.is_available() else torch.float32

model_id = "openai/whisper-large-v3"

model = AutoModelForSpeechSeq2Seq.from_pretrained(

model_id, torch_dtype=dtype, low_cpu_mem_usage=True, use_safetensors=True

).to(device)

proc = AutoProcessor.from_pretrained(model_id)

pipe = pipeline(

"automatic-speech-recognition",

model=model,

tokenizer=proc.tokenizer,

feature_extractor=proc.feature_extractor,

device=device,

torch_dtype=dtype,

)

print(pipe("audio.mp3")["text"])

-

高频需求参数:

-

指定源语言:

generate_kwargs={"language": "english"}; - 做英译:

generate_kwargs={"task": "translate"}; - 返回时间戳:

return_timestamps=True或"word"。

长音频与提速技巧(官方推荐)¶

- 顺序式(sequential):30s 滑窗逐段推理,精度略优,适合批量转写或精度敏感场景。

- 分块式(chunked):按段并行、边界拼接,速度优先;对单条长音频、在线业务更友好。启用示例:在

pipeline中传chunk_length_s=30与合适的batch_size。 torch.compile加速:在不使用分块与 FA2 时可获得最高约 4.5×前向加速;配合静态缓存与 SDPA(scaled dot-product attention)进一步优化显存与吞吐。

规格速记与生态¶

- 参数量:约 1.54B;多语 large-v3 为 1550M 档位;支持 safetensors / FP16。

- Transformers 原生支持:转写、英译、时间戳、多种解码启发式(如温度回退、前缀条件)均有范例。

- 社区与部署:Hugging Face 上已有大量基于 large-v3 的 Spaces / 适配与微调,便于即插即用或二开。

实战落地的小建议¶

- 多语言评估要看“你的数据”:即便总体降错明显,语言/口音/录音条件差异仍可能显著影响效果,建议抽取实采样本做 A/B。

- 长音频优先分块:在线业务侧重秒级响应时,分块式 + 合理批大小通常更稳。

- 遵守用途边界:避免将 ASR 输出直接用于敏感属性推断或身份识别。

参考¶

- 模型卡(含安装、示例、长音频策略、加速建议、许可信息):Hugging Face – openai/whisper-large-v3。

- Whisper 项目与论文背景:OpenAI Whisper / arXiv:2212.04356(模型卡内给出引用入口)。

总结:Whisper large-v3 以更细的声学表征与更大的训练混合数据,兑现了跨语言稳步降错与工程化落地的双重承诺。若你的应用涉及多语、长音频或在线转写,这是 2025 年仍然值得优先选型与基准对比的开源 ASR 基座。