Integrating AI and ML into COP and COA Development¶

将人工智能与机器学习技术融入通用作战图与行动方针制定¶

C. Anthony Pfaff

Christopher John Hickey

2025年7月

战略研究院

美国陆军战争学院

本出版物中所表达的观点仅代表作者个人观点,并不一定反映美国陆军部、国防部或美国政府的官方政策或立场。战略研究院与美国陆军战争学院出版社的作者在不泄露机密信息、不危及行动安全或不歪曲官方政策的前提下,享有充分的学术自由。这种学术自由使他们能够从新的、甚至具争议性的视角出发,推动关键议题的讨论。本出版物经批准公开发布,传播不受限制。

ISBN 1-58487-865-7

©2025 C. Anthony Pfaff. 保留所有权利。

战略研究院(Strategic Studies Institute,简称SSI)作为陆军的智库发布国家安全与战略研究及分析成果,旨在回答战略安全问题、为战略决策提供信息支持,并在陆军与联合作战部队之间建立战略安全知识网络。

SSI 是思想与批评的重要源泉,提供创新方法与独立分析,并为外部读者展示美国陆军对国家安全的贡献。它同时作为桥梁,连接更广泛的国际安全学者与从业者社群。

SSI 由民间研究教授、现役军官与专业支持人员组成,成员均具有丰富的资历与经验。其战略研究与分析部门聚焦全球、跨区域及功能性安全议题;其战略参与项目(Strategic Engagement Program)则与全球战略分析人士及军事战略领域的顶尖学者保持长期合作。每年约有一半出版物由这些外部合作伙伴撰写。

SSI研究重点领域:

- 地缘战略综合评估:区域与跨区域威胁分析;对手行为驱动因素;盟友、合作伙伴、跨机构、商业与联合组织之间的互操作性

- 地缘战略预测:地缘政治、地缘经济、技术发展、颠覆与创新

- 应用战略艺术:战争与作战功能、联合及多国战役行动、冲突谱系

- 工业/企业管理、领导与创新:伦理与职业规范、组织效能、变革性发展、人才培养与管理、力量动员与现代化

前言¶

《将人工智能与机器学习技术融入通用作战图与行动方针制定》旨在探讨联合作战部队如何更好地理解并应用人工智能(AI)与机器学习(ML)技术于军事规划过程中。为实现这一目标,本研究聚焦现代防务机构所面临的关键挑战之一:如何利用AI与ML的变革性力量提升态势感知(situational awareness)并优化行动方针制定(course of action development)。

本研究延续了《信任人工智能:将人工智能融入陆军专业知识体系》(Trusting AI: Integrating Artificial Intelligence into the Army's Professional Knowledge)的基础成果,深入分析将AI整合入美国陆军通用作战图(Common Operational Picture, COP)的技术、组织与资源需求,重点关注其伦理实施与作战可持续性。通过多维度方法,作者不仅探讨技术演进,还分析为充分发挥AI决策支持作用所需的结构与文化变革。

本研究发布于关键时刻。美国国防部已认识到AI在形成持久决策优势方面的潜力,但其应用仍受制于组织壁垒、数据挑战与资源限制。研究通过详尽分析识别了关键缺口,并为自上而下的战略规划与自下而上的实操落地提供可行性方案。

最终,本研究为利用AI增强军事规划与作战准备提供了系统框架。当陆军与联合作战部队在日益复杂的作战环境中运作时,本报告中的洞见与建议将对领导者、规划者及技术人员在数字时代的适应与创新起到重要参考作用。

——C. Anthony Pfaff

战略研究院与美国陆军战争学院出版社主任

执行摘要¶

本综合研究项目探讨了如何将人工智能(AI)与机器学习(ML)技术融入联合作战规划流程,特别是用于提升通用作战图(COP)与行动方针制定(COA)环节。研究通过技术、组织、资源及伦理四个维度,分析AI/ML的应用机会,以优化态势感知与决策制定。

AI/ML 技术能够处理海量数据、简化规划任务并生成可操作洞察,但前提是具备稳健的数据采集、结构化与管理机制。研究同时考察组织层面的影响,包括角色变动、分工调整及外部承包商的参与;并分析资源约束下的可持续性问题。此外,研究贯穿伦理考量与“负责任人工智能(Responsible AI)”原则,以确保技术应用符合社会价值与军事标准。

研究采用非结构化访谈与二手数据审查方法,评估自上而下与自下而上两种AI/ML整合路径。发现的主要障碍包括数据标准化不足、跨密级访问受限及组织实践与新兴技术间的不匹配。研究强调建立集中而灵活的框架,以系统性应对上述挑战,并提出推动AI/ML在军事规划中落地的可执行建议。整体而言,本研究为在复杂动态的军事环境中开发、应用与优化AI/ML提供了战略指导。

关键发现¶

- 技术挑战:AI成功集成依赖高质量、结构化且精心整理的数据。虽然AI可自动执行重复性任务(如数据过滤与目标识别),但其有效性取决于数据结构与数字基础设施。诸如Maven Smart System(MSS)与STORMBREAKER等新兴工具展示了AI在提升传感器数据融合与异常检测方面改进通用作战图(COP)的潜力。

- 组织影响:AI的引入要求文化与结构性转变。规划人员需掌握AI工具技能,军队需在规划过程中长期引入私营承包商。AI的应用还将重塑总部作业模式,重新分配职责、减轻参谋负担。

- 资源需求:AI系统依赖云计算、带宽与算力,而这些资源在作战条件下可能难以维持。当前自下而上的创新缺乏长期资金支持,而自上而下的政策则需更好地对接作战需求。

- 伦理考量:对AI输出的信任是作战成功关键。系统必须符合“负责任人工智能”原则——可靠、透明、可治理——同时规避数据偏差、过度依赖与“幻觉”(AI生成错误)等风险。

尽管AI为规划流程带来巨大潜能,其成效仍取决于技术、组织与资源层面的系统应对。通过负责任地利用AI,美国军队可提升决策能力、保持作战优势并更好地应对复杂战场。

引言¶

在《信任人工智能:将人工智能融入陆军专业知识体系》研究基础上,本项目从技术、组织、资源与伦理四个维度探讨人工智能(AI)驱动的军事规划决策支持系统的研发与采购,旨在为理解与优化这类新兴技术提供系统性框架,从而更高效地将AI融入美军规划流程中。

AI 技术正如十九世纪末至二十世纪初的电力革命般,重塑一切运行机制。美国国防部寄希望于此颠覆性技术,期望通过其获得长期的决策优势,包括:战场感知与理解、灵活的兵力筹划与运用、快速精确的杀伤链(kill chain)、有韧性的保障支援以及高效的企业运营。\({ }^{1}\) 本研究分析防务体系当前AI整合情况,并展望未来前景。除关注技术挑战外,亦探讨国防部如何应对AI带来的组织与资源变革压力。

技术层面¶

探讨AI/ML如何改进联合作战规划流程,特别是在生成更及时、更准确的通用作战图(COP)与推动行动方针制定(COA)上。研究指出,关键在于理解AI/ML加速与未加速环节的区别,其核心在于数据的获取、结构化与管理。基于当前技术能力与局限,研究进一步提出AI作为联合作战赋能者的政策建议与数据治理策略。

组织层面¶

军事规划依赖团队协作。AI的引入影响到组织架构、知识需求与技能分布。AI的应用将导致总部结构调整、信息流优化及分工再配置,几乎所有参与规划的人员都需掌握新知识与技能。由于高端技术能力主要集中在私营部门,如何长期将外部厂商融入规划流程将是关键挑战。

资源层面¶

AI/ML虽能提高规划效率,但对资源依赖极高,包括云接入、数据采集与管理、GPU算力及模型成本。可靠连接与高带宽在战场上可能无法保障,导致系统可持续性受限。研究评估了自下而上与自上而下两种AI/ML能力建设的资源投入是否充足与长期可行,并明确单位在利用新能力时所需资源的构成与成本。

研究方法¶

本研究采用非结构化访谈与二次文献分析方法,首先确定在联合作战规划中将AI/ML融入通用作战图(COP)与行动方针制定(COA)所需的技术、组织与资源条件;其次,分析当前的自上而下(top-down)与自下而上(bottom-up)整合路径。前者包括陆军首席数字与人工智能办公室(CDAO)及陆军未来司令部(AFC)等机构;后者包括印太司令部、美军欧洲与非洲司令部、第18空降军及驻韩美军等的实践经验。

参考术语定义¶

规划(Planning):指在战略与战役层面,为实现特定目标而协调手段、方式与资源的军事过程,同时考虑约束与威胁。\({ }^{2}\)

通用作战图(Common Operational Picture, COP):国防部将COP定义为“由多个指挥机构共享的单一、统一的相关信息显示,以促进协同规划并帮助各级指挥层实现态势感知”。\({ }^{3}\)

行动方针(Course of Action, COA):依据《国防部军事与相关术语词典》,COA是个体或单位可采取的活动序列或完成任务的方案。\({ }^{4}\)

人工智能(Artificial Intelligence, AI):计算机科学与工程的多学科领域,旨在构建能执行通常需人类智能的任务之系统,如学习、推理、问题求解、感知、语言理解与交互。

机器学习(Machine Learning, ML):人工智能的一个子领域,专注于开发能基于数据学习并进行预测或决策的算法与统计模型。ML系统通过分析数据中的模式不断提升特定任务的表现。鉴于AI与ML高度重叠,本研究以“AI/ML”统称,表示二者在军事应用中的综合影响与发展。

数据(Data):数据是经过编码的信息,是知识推导的基础。测量产生信息,信息被处理并可存储与传输后即成为数据;将数据置于上下文中即可形成数据集。例如,将士兵姓名、体能测试成绩与训练时间关联组成的数据即为数据集。\({ }^{5}\)

自然语言处理(Natural Language Processing, NLP):使机器能够理解并以有意义且有用的方式响应人类语言的能力。\({ }^{6}\)

人机协同(Human-Machine Teaming, HMT):由至少一个人类与一个AI/ML系统组成的团队,共同为实现目标而协作。HMT结合人类的判断、直觉与创造力,与AI的数据处理、模式识别与预测分析能力,形成更具韧性与效率的混合决策模型。\({ }^{7,8}\)

负责任人工智能(Responsible AI):指在设计、开发与部署AI系统时,使其符合伦理原则、社会价值与法律标准。其核心特征包括:负责任、公平可及、可追溯、可靠与可治理(responsible, equitable, traceable, reliable, governable)。国防部《负责任人工智能战略与实施路线图》强调,应通过防止偏差、保护隐私、促进公平使用来建立信任,确保AI系统为所有相关方带来积极效益并最小化潜在负面后果。\({ }^{9}\)

人工智能与数据的挑战(The AI-Data Challenge)¶

要有效运用人工智能(AI)与机器学习(ML),必须收集足够数量且类型正确的数据,并对其进行结构化处理或以其他方式使算法能够访问。有效应用AI还要求对模型(即数据与算法的组合)进行测试与评估,以确保其在实际使用中表现良好。此外,需高度重视数据卫生(data hygiene),以便模型能够检测并修正算法偏差(algorithmic bias)与数据漂移(data drift),这些内容将在第一章中进一步讨论。然而,现实世界中往往缺乏质量或数量合格的数据,因此开发者不得不依赖仿真数据。仿真数据可用于模型训练,但也存在强化原始数据偏差的风险。此外,判别式人工智能(discriminator AI,用于分类数据)与生成式人工智能(generative AI,用于生成数据)的比较也带来了问题,尤其是在确定哪些内容应被整合以支持决策时。建立稳健的评估框架至关重要,但仍需依赖真实数据来测试与评估系统的有效性。

尽管许多技术问题可以解决,但行政障碍与权限问题常阻碍进展。采购过程中的挑战——包括聘请具备专业合同管理能力的专家——需要不同层级的专业知识,而这些知识通常与作战职能无关。和平时期与战时的训练差异也是一大难题,因为和平时期收集的数据可能无法反映战争中的真实环境。和平与战争数据的差异强调了全作战层级标准化的必要性,以及系统更新的权限应明确分配。尽管存在行政与授权方面的顾虑,但依赖商业供应商仍是国防部(DoD)AI采购项目的优势之一。由于商业AI应用能带来可观收入,且通常易于适配军事需求,因此商业部门能够承担比传统军工系统更大的研发负担。

人工智能(AI)有潜力通过简化诸如通用作战图(Common Operational Picture, COP)生成与行动方针(Course of Action, COA)制定等流程,彻底变革军事规划。但要实现这种革命性变革,军队组织结构必须进行重大调整,尤其是在规划人员的知识与技能方面。尽管AI的应用可以减少规划参谋的人数,但转向AI驱动的作业方式将需要重新分配职责,包括长期将外部供应商纳入规划流程。个体参谋的角色也将受到显著影响,因为AI与数据分析技能将成为关键能力。

本项目回顾的几乎所有应用都采用了判别式模型(discriminator model),其作用是将数据分类为不同类别,如识别威胁或区分正常与恶意活动。判别式模型在检测异常、识别模式与基于历史数据进行二元决策方面尤为有效。通过在带标签的数据集上训练,这类模型能够学习预定义类别间的差异并据此预测结果,这对于欺诈检测、垃圾邮件过滤与网络安全中的威胁识别等任务至关重要。尽管这类模型功能强大,但通常需要大量高质量的标注数据,并且容易受到训练数据中偏差的限制。

目前,生成式人工智能(generative AI)在规划与作战中仍处于早期阶段,但其作用正逐步扩大。判别式模型主要负责数据分类,而生成式模型则旨在生成与训练数据相似的新数据。生成式模型通过学习数据的底层分布,生成逼近真实世界的合成数据点。如何将生成式AI融入军事规划仍在探索中。例如,判别式模型可用于目标识别,而生成式模型则可帮助理解打击的战略意义。当判别式模型(如 Maven Smart System, MSS)可精确识别作战区域内的敌方坦克时,生成式模型则可解释摧毁这些坦克的重要性。例如,生成式AI可能生成这样的分析:“在Alpha目标点摧毁五辆敌方坦克将暴露敌军翼侧,迫使其从主攻方向调动相同兵力或放弃翼侧防御。”\({ }^{10,11}\)

其他应用场景包括可辅助规划人员的AI助理。例如,美国陆军战争学院的 William Barry 开发了一种混合生成式AI助理——“人工智能赋能战略顾问”(Artificial-Intelligence-enabled Strategic Advisor, AIeSA),结合了机器学习(ML)与自然语言处理(Natural Language Processing, NLP),用于增强人类的规划过程。在一次模拟太平洋地区人道主义任务的演习中,AIeSA 成功执行了关于步兵营机动至港口的复杂计算。在课堂教学中,AIeSA 还能通过总结复杂内容、回答教师问题来帮助学生理解课程。\({ }^{12}\) 虽然这并非严格意义上的军事规划,但与参谋为指挥官提供决策方案的过程非常相似。

AI/ML 的整合同样资源密集,需要云技术访问、数据管理与高性能计算资源,导致训练成本上升,并且在野战条件下难以维持。例如,在作战环境中维持AI的可持续性受到带宽与算力等资源限制的挑战。本项目评估了国防部现行资金机制与资源分配模式的可行性。

国防部人工智能整合简史¶

美国国防部(DoD)在自上而下与自下而上的两个层面都进行了AI/ML的整合。机构层面的AI整合始于2018年,当时国防部成立了联合人工智能中心(Joint Artificial Intelligence Center, JAIC),并发布AI战略,强调加速AI的采用与整合,以保持战略与作战优势。\({ }^{13}\) 正如本研究所指出的,与产业界的合作及其融入军事行动的机制将是AI成功采用的关键,同时还需建立一支具备技术素养的部队。AI战略最重要的成果之一是成立JAIC这一专责机构,以统筹国防部内的AI整合工作。

JAIC 被赋予四项关键任务:识别与交付原型、共享经验并将研究成果融入行动、推广成功原型以及提供持续支持。\({ }^{14}\) 战略文件指出:“尽管其主要职责是执行,JAIC在协调国防部各组成部门的AI活动方面也将发挥关键作用。”\({ }^{15}\) JAIC 还承担着协调国防部、其他政府机构、工业界、学术界及盟国伙伴间AI合作的职能。\({ }^{16}\) 此外,作为集中机构,JAIC 能调解军种间的AI分歧,避免重复建设与资源浪费。

次年,即2019年,《国防部数字现代化战略》(DoD Digital Modernization Strategy)强化了AI作为国防创新支柱的地位。\({ }^{17}\) 战略指出,AI是仅次于网络安全的军事准备与杀伤力关键支撑,要求国防部采用敏捷实践、培育创新文化,并加强与产业界和学术界的协作。

继之,2020年发布的《国防部数据战略执行摘要》(Executive Summary: DoD Data Strategy)提出了改进数据质量、敏捷性与可访问性的方案,为数据驱动决策创造良好环境。\({ }^{18}\) 战略强调需建立遵循伦理准则且能抵御对抗攻击的AI基础设施,目标是打造“数据可见、可访问、可理解、可关联、可信赖、可互操作且安全”的数据中心文化。\({ }^{19}\)

该战略特别强调,应建立集中化的数据治理机构与作战一线用户间的双向联动机制,以实现“自下而上的优化”。作战单位可据此参与训练设计并验证上级机构(如JAIC)的假设与成果。同年,国防部发布《AI教育战略》(DoD AI Education Strategy),旨在培养具备AI整合能力的专业人才。\({ }^{20}\) 战略将AI培训划分为六种类型:引领AI(lead AI)、驱动AI(drive AI)、创造AI(create AI)、促进AI(facilitate AI)、嵌入AI(embed AI)与应用AI(employ AI),以在全政府范围内建立系统化教育体系。

2021年,《国家安全人工智能委员会报告》(National Security Commission on Artificial Intelligence Report)发布,提出多层次国家安全AI战略,包括加速AI在防务与安全任务中的应用、建设AI人才队伍及保持美国AI技术优势。\({ }^{21}\) 报告建议国防部应“在2025年前建立AI广泛整合的基础”,包括建设统一的数字基础设施、培养数字素养军队,并从不适配AI的传统系统中战略性退出。\({ }^{22}\) 报告强调:“五角大楼领导层必须立即推动组织改革。”\({ }^{23}\)

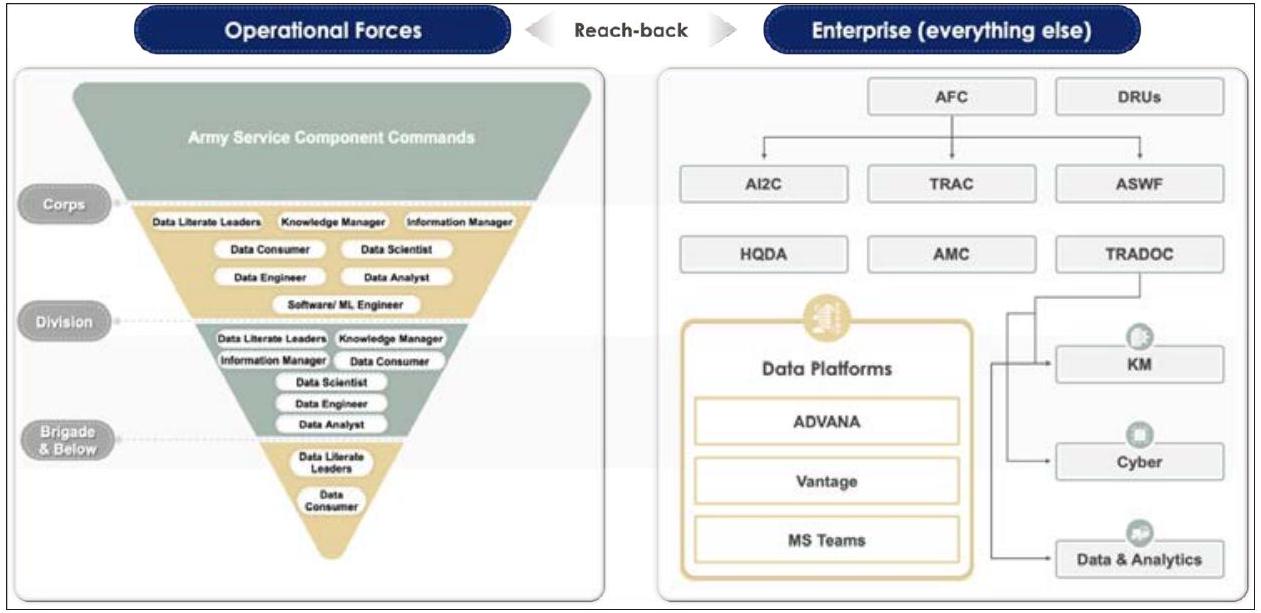

2022年6月,国防部长办公室设立了“首席数字与人工智能办公室”(Chief Digital and Artificial Intelligence Office, CDAO),负责推动AI与数据驱动技术在整个国防体系中的整合与互操作,以形成从战略层到战术层的决策优势。\({ }^{24}\)

CDAO 确定了未来AI人才所需的五类关键角色:

1. 创新领导者——负责制定组织的AI愿景、政策与解决方案;

2. 风险与伦理专家——评估AI使用的技术与社会风险;

3. 应用与平台专家——设计、开发与维护AI应用与平台;

4. 测试与评估专家——验证平台以确保其可靠、安全与可治理;

5. 采纳专员——支持组织内用户的AI应用。

CDAO计划于2024财年推出军民人员在线培训项目,持续建设AI赋能的国防体系。\({ }^{25}\)

2023年,美国人事管理办公室(US Office of Personnel Management)发布《2023–2026年数据战略》(Data Strategy: Fiscal Years 2023–2026),将数据确立为制定政策、预算与运营决策的战略资产。\({ }^{26}\) 战略重点在于通过强化数据治理与分析创新,培养以数据驱动创新的公务员队伍,并树立联邦机构榜样。其核心目标是提升分析能力,使人员能够理解并应用数据分析,以应对复杂的公共管理环境。

随后,《2018国防部人工智能战略摘要》与《2020国防部数据战略执行摘要》被2023年发布的《国防部数据、分析与人工智能采纳战略》(DoD Data, Analytics, and Artificial Intelligence Adoption Strategy)所取代。\({ }^{27}\) 国防部副部长 Kathleen Hicks 强调:“本战略是我们在整个国防体系中部署数据、分析与AI能力以实现持久决策优势的指南。”\({ }^{28}\) 她指出:“实现数据、分析与AI的全部潜力,不是一家机构或单一项目的职责,而是我们共同的使命。”\({ }^{29}\)

该战略凸显集中化指导与作战层反馈机制之间的互动关系,强调快速整合新能力与灵活响应战场反馈的重要性。然而,文件并未具体说明各级单位应如何在组织层级上落实AI的采纳步骤。

总体而言,国防部各项战略勾勒了维持竞争优势与支撑决策流程的AI采用目标,并展示了防务体系通过组织变革积极拥抱AI的努力。这些互相支撑的战略文件与结构调整表明,国防部正视AI为下一代独特作战工具及潜在革命性基础技术的角色。

然而,这些战略文件与举措在实际AI落地步骤上仍显不足,例如缺乏基础设施建设细节、人员技能培养路径及最优的组织整合模式。当前的战略治理尚未明确如何在现代化改革及部队结构裁减(如陆军计划到2029年减少2.4万现役人员\({ }^{30}\))的背景下加速AI应用。因此,落实自上而下的战略指导,仍需各军种自主承担。服务层面必须应对AI整合的四大挑战:

1. 确定AI在传统规划中的增效范围;

2. 评估组织变革的需求与影响;

3. 量化资源需求与机会成本;

4. 确保伦理规范贯穿AI整合全过程。

结论¶

将AI/ML融入陆军规划流程代表军事战略演进的关键一步。尽管在数据处理与资源配置方面仍面临重大挑战,但AI在提升决策速度、优化COA制定及增强态势感知方面的潜力不容忽视。未来工作应聚焦于建立支持AI的稳健基础设施、整合伦理准则,并确保AI/ML应用在各作战环境下的可及性与可持续性。

本研究为国防部在将AI技术融入军事规划时提供了可操作的框架与建议。以下章节将围绕引言中提出的四大挑战展开分析,构建一套系统框架,用以识别AI的技术能力边界、组织适应路径、全寿命周期成本及伦理考量。总体而言,本项目为AI/ML在军事规划中的现实应用确立了合理预期,并为未来AI整合提供了切实可行的路线图。

Endnotes¶

- US Department of Defense (DoD), Department of Defense Data, Analytics, and Artificial Intelligence Adoption Strategy: Accelerating Decision Advantage (DoD, June 27, 2023), 4.

- Joint Chiefs of Staff (JCS), Joint Planning, Joint Publication 5-0 (JCS, June 16, 2017).

- JCS, DOD Dictionary of Military and Associated Terms (JCS, March 2017), 46.

- JCS, \(D O D\) Dictionary, 46.

- Alex J. Gutman and Jordan Goldmeier, Becoming a Data Head (Wiley, 2021), 16-18.

- Cole Stryker and Jim Holdsworth, "What Is NLP (Natural Language Processing)?," IBM, August 11, 2024, https://www.ibm.com/topics/natural-language-processing.

- Vincent A. Lillard et al., DATAWorks 2022: Topological Modeling of Human-Machine Teams (Institute for Defense Analyses, April 2022).

- Lillard et al., Topological Modeling, 67.

- DoD Responsible AI Working Council, U.S. Department of Defense Responsible Artificial Intelligence Strategy and Implementation Pathway (DoD, June 2022), 4-8.

- Joe O'Callaghan, interview by the author, November 6, 2024.

- O'Callaghan, interview.

- William Barry and Aaron Wilcox, "Hybrid Intelligence: Decision Dominance at the Strategic Level," War Room, October 17, 2024, https://warroom.armywarcollege.edu/articles/hybrid-intelligence/.

- Terri Moon Cronk, "Joint Artificial Intelligence Center Has Substantially Grown to Aid the Warfighter," DoD, November 18, 2020, https://www.defense.gov/News/News-Stories/Article /Article/2418970/joint-artificial-intelligence-center-has-substantially-grown-to-aid-the-warfigh/; and DoD, Summary of the 2018 Department of Defense Artificial Intelligence Strategy: Harnessing AI to Advance Our Security and Prosperity (DoD, 2019).

- DoD, Summary, 9-10.

- DoD, Summary, 10.

- DoD, Summary, 10.

- DoD, DoD Digital Modernization Strategy (DoD, July 12, 2019).

- DoD, Executive Summary: DoD Data Strategy (DoD, September 30, 2020).

- DoD, Executive Summary, 10.

- DoD, DoD AI Education Strategy (DoD, September 2020).

- National Security Commission on Artificial Intelligence (NSCAI), Final Report (NSCAI, 2021).

- NSCAI, Final Report, 9.

- NSCAI, Final Report, 9.

- "Chief Digital and Artificial Intelligence Office," Chief Digital and Artificial Intelligence Office, n.d., https://www.ai.mil/.

- Angela R. Cough, interview by the author, February 28, 2024.

- US Office of Personnel Management, Data Strategy: Fiscal Years 2023-2026 (Office of Personnel Management, March 2023).

- DoD, Adoption Strategy.

- DoD, Adoption Strategy, 1.

- DoD, Adoption Strategy, 1.

- "Army Force Structure Transformation" (white paper, US Army, February 27, 2024).

1. 将人工智能融入规划的技术要求¶

规划概述¶

要将人工智能(AI, Artificial Intelligence)与机器学习(ML, Machine Learning)技术融入规划,首先必须理解这些技术将被应用的过程。本节描述了美国陆军及联合部队在战略、战区战略、作战与战术层级的陆军军团司令部的规划过程。本节超越了许多关于战争中AI相关文献的焦点——这些文献通常高度关注战术行动与战略核问题——转而探讨ML与数据技术如何改进共同作战图(COP, Common Operational Picture)与行动方案(COA, Course of Action)开发的关键组成部分,而这正是规划的核心环节。

《陆军条令出版物5-0》(Army Doctrine Publication 5-0)将规划定义为“理解局势、构想理想未来,并确定实现该未来的有效途径的艺术与科学。”\({ }^{1}\) 规划的科学部分包括客观的量化判断,例如计算燃料消耗、机动速率、弹药消耗、路线优化、地形效应、武器能力与部队战备等级等,这些可量化内容构成了规划的科学基础。\({ }^{2}\) 而诸如部队编组与战术运用等基于这些量化考量的主观判断,则构成了规划的艺术部分。\({ }^{3}\) 可量化与可感知因素的相互作用形成了复杂问题——至少到目前为止——仍然需要人类智能来解决。

《联合出版物5-0》(Joint Publication 5-0, Joint Planning)阐述了联合指挥部的规划条令,主要关注作战至战略层级。在该条令体系中,“规划包含四个功能、规划过程及一种作战设计方法论。”四个规划功能为战略指导、概念发展、计划制定与计划评估。这些功能“通常是顺序进行的,但往往可并行以加快进程。”\({ }^{5}\) 联合规划中的作战设计方法论(operational design methodology)是一种基于设计思维的过程,运用系统思维、创造性思维与批判性思维,并结合作战艺术,以理解环境与战略指导,定义问题,并制定作为COA开发框架的作战方案。\({ }^{6}\) 《联合规划》提出了联合规划过程(JPP, Joint Planning Process)的七个步骤:规划启动(步骤1)、任务分析(步骤2)、COA开发(步骤3)、COA分析与兵棋推演(步骤4)、COA比较(步骤5)、COA批准(步骤6)以及计划或命令制定(步骤7)。\({ }^{7}\)

陆军司令部及部队在不同战争层级采用多种规划条令,所用的支撑工具也因作战层级与规划梯队而异。在战区层级的战略与作战规划中,陆军通常使用《联合出版物5-0》中详述的JPP与作战设计方法,以为陆军服役部件司令部(Army Service Component Commands)、战区陆军(Theater Armies)或担任联合任务部队/地面组成部队司令部的陆军军团与师级单位制定战役计划、作战计划与作战命令。\({ }^{8}\) 在更多情况下,陆军规划者使用陆军条令进行规划。例如,他们采用《陆军技术出版物5-0.1》(Army Techniques Publication 5-0.1)中的陆军设计方法(ADM, Army Design Methodology)以及《野战手册5-0》(Field Manual 5-0)中的军事决策制定过程(MDMP, Military Decision-Making Process)。\({ }^{9}\) 举例来说,一个军团司令部在战争中可同时承担作战层级与战术层级的规划任务:既要规划与监督作战行动,又要规划与协调战斗任务。在此情况下,军团司令部通常会在与上级联合司令部共同进行联合规划的同时,运用陆军条令来规划军团自身的行动。\({ }^{10}\) 这种方法在实践中效果良好,因为两种过程在逻辑上相似。

任何层级的规划都可以是概念性的或细化的、蓄意的或临时的、结构化的或非结构化的,取决于当时的情况、时间与资源条件。\({ }^{11}\) 陆军的作战过程(operations process)是一个持续循环的过程,涵盖规划、准备与执行,并伴随随时变化的任务和局势进行持续评估。指挥官主导这一过程,必须理解作战环境、构想并描述作战的预期终态。通过规划与命令流程,各级指挥官将部队引导至设想的目标终态与任务完成。\({ }^{12}\)

无论采用何种规划层级或方法,“指挥官与参谋人员在整个作战过程中都致力于构建与保持态势理解。”态势理解是通过对相关信息进行分析与判断,从而确定作战与任务变量之间关系的产物。\({ }^{13}\) 这种理解对规划至关重要,也对参谋人员提出了极高要求,他们必须尽可能多地收集数据,并将其转化为与当前局势相关的信息与知识。获得这种态势理解需要开发合适的传感器以收集数据、将原始数据处理为信息,并获取足够的基础数据以支撑分析。这些要求与AI和ML无关——它们只是重述了参谋人员历来执行的工作:收集信息、推断意义、决定响应。任务分析、参谋评估、报告与持续的作战环境情报准备(intelligence preparation of the operating environment, IPoE)都是发展态势理解的必要环节。\({ }^{14}\) AI与ML可以在此过程中发挥作用——它们能处理现代作战中庞大的信息与数据量,减轻人类负担,从而支持更有效的决策制定。

共同作战图(COP)开发¶

根据《联合出版物3-0》(JP 3-0, Joint Campaigns and Operations)的定义,COP是“由多个指挥部共享的单一且一致的相关信息显示,用以促进协同规划并帮助各梯队实现态势感知。”\({ }^{15}\) 理想的COP在实战中常被称为“单一视窗”(single pane of glass),即创建、维护与分发跨梯队可访问的相关信息,以实现并保持态势理解。\({ }^{16}\) 成功的COP使指挥官、参谋与下级领导能够在作战中专注于关键信息。此外,COP有助于对动态战术局势迅速响应,帮助指挥官进行知情决策、协调兵力并保持主动权。同时,COP有助于指挥官在作战过程中快速传达调整,并支撑在预期变化下制定替代COA的规划。\({ }^{17}\) 因此,COP是有计划地开发COA、快速决策并确保对手作战优势的关键工具。

COP的标准化内容尚未确立,其具体内容取决于指挥官的信息需求(IRs, Information Requirements)。\({ }^{18}\) COP可为数字或模拟形式,取决于作战环境中的网络连通性。典型的COP是作战区域的数字地图,带有多个叠加层,用户可根据指挥官与参谋的判断自由开关。陆军的《指挥官与参谋组织及作业》(Commander and Staff Organization and Operations)中列出了图1-1所示的作战层级COP清单。\({ }^{19}\)

| 序号 | 检查项目 |

|---|---|

| 1. | 作战区域(AO, Area of Operations)内部队边界与当前位置 |

| 2. | 机动图形 |

| 3. | 活动及计划中的火力支援协调措施 |

| 4. | 活动及预令中的空域协调措施 |

| 5. | 不规则敌对力量与非对称威胁 |

| 6. | 后勤节点与主补给线(MSR, Main Supply Route) |

| 7. | 民事因素 |

| 8. | 已知与模板化威胁、危险、敌方位置与敌方活动 |

| 9. | 对手的信息作战活动 |

| 10. | 东道国与政治因素 |

图1-1. COP 检查清单示例

COP可由多种信息源支撑。参谋人员在规划与作战过程中开发这些信息源,如图1-2所示。\({ }^{20}\) 所有参谋部门都会在规划与作战过程中生成初步评估并持续维护各自职责领域的动态评估(running estimates)。\({ }^{21}\) 开发与维护动态评估是一项重大挑战,计划与执行的成功依赖于其中信息的相关性与时效性。为了对指挥官有价值,这些动态评估必须包含原始数据,并分析、综合与作战相关的信息,明确其对作战的影响。鉴于这些挑战,参谋应将动态评估限制在必要信息范围内,以避免信息过载、延误决策。AI与ML在此环节可发挥重要作用。

在ADM与MDMP的任务分析阶段,以及初始的作战环境情报准备中,指挥官与参谋制定信息需求(RFI, Requests for Information)与指挥官关键信息需求(CCIRs, Commander’s Critical Information Requirements),其中包括友军信息需求(IRs)与优先情报需求(PIRs, Priority Intelligence Requirements),以完善知识并指导决策及情报收集工作。报告与RFI、CCIR、友军IR及PIR的反馈持续构建与保持态势理解。然而,在动态环境中,无论信息量多大,都无法提供完全的态势理解或消除不确定性。\({ }^{22}\)

行动方案(COA)开发¶

COA通常与规划的艺术相联系,它是一个综合性解决方案,通过开发过程形成,与指挥官意图和指导保持一致。该过程利用任务相关陈述与知识产品,应用作战与战术艺术,通过调整阶段(phasing)与节奏(tempo)等要素创建多种COA。尽管指挥官可能会限制COA数量以加快流程,但团队必须承认并应对作战环境的固有不确定性。当由人类执行时,过程所能处理的变量与场景数量存在局限。专注于可控因素与已知信息(如敌方位置)有助于开发具备适应性的COA。采用这种方法可在不确定性中保持作战灵活性,避免削弱行动效率,从而形成灵活有效的COA。\({ }^{23}\)

图1-2. COP输入与输出示意

图1-2. COP输入与输出示意

陆军设计方法(ADM, Army Design Methodology)能够帮助理解模糊问题,并在行动方案(COA, Course of Action)开发中提供灵活性。根据《野战手册5-0》(Field Manual 5-0),“ADM是一种跨学科的规划与问题求解方法。它结合了军事理论、关于问题本质的研究,以及批判性与创造性思维的挑战。其中一些概念,如作战艺术(operational art),长期以来与规划密切相关。”\({ }^{24}\) ADM中使用的许多概念对于AI而言难以实现,或需要特定的AI应用。在ADM中,“系统思维(systems thinking)与框架化(framing)等概念获得了更高重视。与ADM相关的关键概念包括:

- 作战艺术(Operational art);

- 批判性思维(Critical thinking);

- 创造性思维(Creative thinking);

- 系统思维(Systems thinking);

- 协作与对话(Collaboration and dialogue);

- 框架化(Framing);

- 叙事构建(Narrative construction);

- 可视化建模(Visual modeling)。\({ }^{25}\)

根据《野战手册5-0:规划与命令生成》(Field Manual 5-0, Planning and Orders Production),MDMP(军事决策制定过程, Military Decision-Making Process)中的COA开发阶段包括若干子步骤:(1)评估相对战斗力;(2)生成选项;(3)部署兵力;(4)制定总体构想;(5)指派司令部;(6)编写陈述与图示;(7)进行COA简报;(8)选择或修改COA以进行后续分析。\({ }^{26}\) 在该过程之后,作为MDMP的一部分,COA必须通过各种兵棋推演(wargaming)技术进行分析与比较,以便进一步修订与选择。\({ }^{27}\) 这一过程通常是线性的且耗时的,要求指挥官与参谋在信息不完全的情况下,运用其态势理解、条令知识、训练或作战的历史经验以及最佳判断。

技术挑战。 如上文所述,有效的规划要求:(1)理解描述友军与敌军互动的变量;(2)具备计算这些变量如何影响交战结果的能力;(3)能够访问足够健壮且结构合理的数据。这些条件对人类系统与AI/ML系统同样适用。然而,AI与ML系统在计算变量速度上的优势使其与众不同。但要使这些计算具有价值,算法必须能够反映环境的复杂性,且数据应尽可能避免偏差。在作战条件下,环境不断变化,使模型开发更加复杂。此外,如图1-3所示,相关数据来源多样且结构不统一,增加了数据访问的难度。

人工智能的应用¶

要理解如何克服上述挑战,并将AI与ML应用于共同作战图(COP, Common Operational Picture)与行动方案(COA)开发,必须首先了解该技术的基本工作原理。直到最近,AI与ML的主要应用仍集中在情报领域,用于处理海量传感器数据的提炼,采用的是较传统且定制化的AI工具,例如计算机视觉(computer vision)——使用卷积神经网络(CNN, Convolutional Neural Networks)处理视觉数据,或利用人工神经网络(ANN, Artificial Neural Networks)监测竞争对手的社交媒体抓取器。\({ }^{28}\) 当前,各国正竞相将AI与ML纳入军事行动的各个环节,从常规行政事务到作战规划,乃至完全自主的传感器、载具与武器系统。\({ }^{29}\)

这一竞赛的历史比多数人想象的更为久远。早在“沙漠风暴行动”(Operation Desert Storm)时期,美国国防部(DoD, Department of Defense)便使用AI进行规划,采用了动态分析与再规划工具(DART, Dynamic Analysis and Replanning Tool)——一种AI驱动的系统,用于协助人类规划装备与人员从欧洲运往沙特阿拉伯的后勤运输。\({ }^{30}\) 通过DART获得的效率提升,收回了国防高级研究计划局(DARPA, Defense Advanced Research Projects Agency)30年来在AI领域的投资。其实践成果成功证明,将AI嵌入更大型的规划系统中可指数级提升规划效率。\({ }^{31}\)

如图1-3所示,AI指的是一种广义框架,能够高效执行通常由人类完成的任务。ML(机器学习, Machine Learning)是AI的一个子集,能在该框架内从数据中学习。DL(深度学习, Deep Learning)则是ML的一个特化领域,其特征是使用模拟人脑结构的神经网络而非算法。DL算法的定义特征在于“深度”,即其包含的神经网络层数——至少需要四层。\({ }^{32}\) 这些概念与数据科学(data science)存在重叠——后者结合统计学与数学,从数据中提取有意义的洞察并进行预测分析。要实现高效运行,这些系统需要大量经过精心整理的数据,以训练、测试与验证模型,并依托计算框架执行特定任务。

图1-3. AI、ML、DL与数据科学之间的关系

图1-3. AI、ML、DL与数据科学之间的关系

图1-4展示了学习算法的一般流程。\({ }^{33}\) 该流程需要收集与处理“选择数据”(select data)与原始数据。“选择数据”指从更大的数据集中挑选出与目标结果相关的数据。例如,依据参谋评估中的数据,模型需要能够选取与维护相关的数据,以识别导致或避免机械故障的维护模式,或预测未来任务不可用率。

一旦数据准备就绪,程序员便可将其输入所选学习算法中以开发候选模型。当模型验证完成后,开发者将其部署于特定应用场景中,并可根据需要重新训练与优化模型。通常,这一过程需要人类介入,以使用标注数据集处理新信息或执行新任务,这种方式称为“监督学习”(supervised learning)。\({ }^{34}\) 某些较新的DL方法,如生成对抗网络(GAN, Generative Adversarial Networks),使用“无监督学习”(unsupervised learning),无需人类干预或标注数据集,即可在无先验知识的情况下发现隐藏的模式、结构或关系。\({ }^{35}\)

图1-4. 学习算法流程(根据Contreras与Vehí文章改绘)

图1-4. 学习算法流程(根据Contreras与Vehí文章改绘)

从功能角度划分,人工智能(AI, Artificial Intelligence)可分为四种类型:反应型机器AI、有限记忆AI、心智理论AI与自我意识AI,其中后两者目前仍属理论阶段。反应型机器AI没有记忆功能,只能执行单一任务——例如IBM的国际象棋超级计算机“深蓝”(Deep Blue)。有限记忆AI能够回忆有限数量的过往事件,以辅助当前的行动方案(COA, Course of Action)决策。此类AI的代表包括生成式AI(Generative AI,如生成式预训练变换模型4,GPT-4 [Generative Pretrained Transformer 4]、Google Gemini Pro、以及大型语言模型Meta AI [LLaMA 2, Large Language Model Meta AI]),以及虚拟助理(如Siri、Amazon Alexa等)。心智理论AI(Theory of Mind AI,属于人工通用智能类型 Artificial General Intelligence)能够推理并理解思想与情感。自我意识AI(Self-Aware AI,属于超级智能类型 Super AI)则将能够“理解自身的内在状态与特征,并理解人类的情感与思想”。\({ }^{36}\)

尽管无法生成完整的AI分类体系,但图1-5展示了AI在众多领域中应用的一种可视化方式,虽不全面,但具有代表性。\({ }^{37}\) 随着科学突破、计算能力的不断提升以及海量数据的积累,AI的发展速度已显著加快。\({ }^{38}\) 近来,大型语言模型(LLM, Large Language Models)与生成式预训练变换模型(GPT, Generative Pretrained Transformers)成为AI与ML领域的焦点。\({ }^{39}\) 大型语言模型(LLM)是许多语音助理与聊天机器人背后的核心技术。这类模型通过估算一个词在前文语境中的出现概率,生成类似人类语言的文本。为实现这一点,LLM需要在海量数据上进行训练。\({ }^{40}\) LLM的应用场景极为广泛,民用企业每天都在推出基于AI的产品与应用。借助将所有输入视为语言的机制,生成式AI产品可以生成文本、将文字或图像生成新的图像、从图像生成文本、将语音转换为文字,并自动生成视频。其中一些生成式AI产品(如ChatGPT移动应用)是多模态(multimodal)的,即可从任意输入生成任意类型输出。\({ }^{41}\)

尽管这些AI平台尚未通过图灵测试(Turing Test)——即验证机器是否具有人类智能的测试——但它们已能表现出令人信服的“类人”特征。\({ }^{42}\) 虽然它们并不具备感知能力,但新一代生成式LLM展现出令人惊讶的“涌现行为”(emergent behavior),即“在小规模模型中不存在、但在大规模模型中出现的能力;因此,无法仅通过小规模模型性能的外推来预测。”\({ }^{43}\) 这种行为可能源于模型访问了不断扩展的互联网数据,以及模型中无监督深度学习(unsupervised deep learning)的进步。但斯坦福大学的研究者指出,LLM的“涌现能力”可能只是由评估指标选择造成的假象,而非模型性能(或智能)实质性变化的体现。\({ }^{44}\)

生成式预训练变换模型(GPT, Generative Pretrained Transformers)是一种特定类型的LLM,能够生成新的文本、视频或图像。GPT在海量数据上预训练,使用了变换器(transformer,一种特定类型的神经网络)的层结构,使模型能够同时处理整段词序列,而非逐词处理。由于GPT已预训练,开发者可以通过额外训练对其进行微调,使其执行特定任务。\({ }^{45}\) 这些模型通过输入数据,根据概率分布预测最可能的输出。

图1-5. AI的部分分类体系

图1-5. AI的部分分类体系

人工智能(Artificial Intelligence, AI) ├─ 机器学习(Machine Learning, ML) │ ├─ 深度学习(Deep Learning, DL) │ │ ├─ 前馈神经网络(Feedforward Neural Networks, FNN) │ │ ├─ 卷积神经网络(Convolutional Neural Nets, CNN) │ │ ├─ 循环神经网络(Recurrent Neural Networks, RNN) │ │ ├─ 生成对抗网络(Generative Adversarial Networks, GAN) │ │ └─ 生成式预训练变换模型(Generative Pretrained Transformer, GPT) │ ├─ 监督学习(Supervised) │ └─ 无监督学习(Unsupervised) ├─ 专家系统(Expert Systems) ├─ 自然语言处理(Natural Language Processing, NLP) │ ├─ 内容抽取(Content Extraction) │ ├─ 分类(Classification) │ ├─ 机器翻译(Machine Translation) │ ├─ 问答(Question Answering) │ └─ 文本生成(Text Generation) ├─ 视觉(Vision) │ ├─ 图像识别(Image Recognition) │ └─ 机器视觉(Machine Vision) ├─ 语音(Speech) │ ├─ 语音转文本(Speech to Text) │ └─ 文本转语音(Text to Speech) ├─ 规划(Planning) └─ 机器人学(Robotics)

为生成预测结果,模型将输入拆分为语言标记(token),这些标记可以是完整单词,也可以是词缀或词根。每个标记通过一个向量(vector)表示——即一组数值,代表该标记在n维空间中的位置,用以描述该标记与其他标记的关系及其在特定提示(prompt)下被关联的概率。图1-6展示了特定语言标记之间的关系——例如“business(商业)”、“strategy(战略)”、“military(军事)”与“COA(行动方案)”。在此例中,“strategy”、“military”与“COA”彼此关联更紧密,而与“business”的相关性较低,这表明在仅包含“strategy”的提示中,这三个词更有可能同时出现在输出中。尽管大多数人类可以直观地想象三维向量空间中的位置,但超过三维的空间则难以可视化;而计算机没有这一限制。GPT的向量规模极大,通常包含数百甚至上千个维度。\({ }^{46}\) 向量维度越多,模型可建立的关联也越丰富。例如,GPT-3为每个标记(可能代表词的一部分或整体)分配一个12,288维的向量(即12,288个数值)以编码其语义。\({ }^{47}\) 借助海量数据,通过神经网络变换器,模型能够在12,288维空间中根据标记的邻近位置建立关联,并利用复杂的向量数学建立更深层次的联系,例如在响应提示时将“military”与“strategy”关联起来。\({ }^{48}\)

图1-6. 三维空间中的数据表示

图1-6. 三维空间中的数据表示

在模型训练过程中,程序员会将标记(token)传递通过多个变换器层(transformer layers),模型会更新向量中的数值以细化其语义。因此,根据训练方式的不同,标记的含义及其与其他标记的关联概率可能有所差异。一旦LLM(大型语言模型, Large Language Models)在海量数据上完成训练,没有人能真正理解其中的内部关系。\({ }^{49}\) 此类模型也容易因训练数据的偏差而产生带偏见的结果。\({ }^{50}\) 这种偏差在军事应用中可能成为问题,因为图像、词汇及其他标记在军事语境中的含义往往与模型数据库中基于通用、流行语境的含义不同。例如,如果某LLM的用户输入的提示多与商业战略相关,则军事用户更可能获得充满商业术语的输出。因此,为改进军事用户的输出效果,必须从头创建新的LLM,或对现有模型进行再训练(retraining)。

此外,输入提示(prompt)的质量也会影响输出结果的准确性。提示中提供的信息越多,模型预测词汇关系的能力就越强。因此,了解如何正确构造输入对于确保模型能够正确理解与关联内容至关重要。与此同时,由于这些模型的输出基于概率关系,它们容易出现“幻觉”(hallucination)现象,即生成错误的输出或使用虚构的数据完成输出。2023年发表于《自然语言处理期刊》(Natural Language Processing Journal)的一项研究对九个主流LLM进行了评估,指出:“约46.6%的生成文本存在事实性错误;52.0%存在话语缺陷,如自相矛盾;31.3%包含逻辑谬误。”\({ }^{51}\)

GPT与LLM基于上下文在数学上建立标记关联,并回忆先前的提示与关联,但它们并不具备知识或对输出的真正理解。这些模型仍属于有限记忆的狭义人工智能(narrow AI)。依赖可能产生偏差或虚构信息的技术,在军事规划中可能造成灾难性后果。因此,为确保该技术有效,参谋与指挥官必须具备快速验证结果的机制。否则,这类技术的使用不太可能较纯人工过程产生显著改进。部分而言,这种能力取决于数据的正确收集、结构化与整理——这正是下一节讨论的主题。

数据与联合及陆军流程¶

正如前文所述,所有AI与ML模型都建立在数据之上。可用于AI与ML开发的数据越多,技术表现就越好。\({ }^{52}\) 性能提升的原因在于大量且多样的数据能让数据科学家更好地精炼与选择特定数据子集,以优化模型训练,这一过程称为“特征选择”(feature selection)。\({ }^{53}\) 然而,许多障碍阻碍了数据的获取。例如,许多数据被锁定在访问受控的存储库中,且在可用于AI模型之前需要进行重构。为改善数据获取,国防部应考虑采用“数据即产品”(data-as-a-product)的模式,创建可复用、标准化的数据资产,以提供针对特定目的的可信数据集。\({ }^{54}\)

在共同作战图(COP, Common Operational Picture)与行动方案(COA, Course of Action)开发中,最相关的数据通常来自传感器或参谋估计,这些数据必须经过结构化处理才能被模型访问。如果这些数据结构不一致,AI与ML项目可能无法定位、访问或检索训练模型所需的全部数据,除非重新组织数据结构。这一重构过程会延长AI项目周期,削弱AI与ML原本提供的速度优势。由于数据源多样,其格式可能无法直接用于模型训练,因此仍需进行数据准备,将其重新格式化为机器可读形式。此类数据保护与处理要求进一步延长项目时间,有时甚至需要回溯至数据采集阶段。

参谋估计与共同作战图¶

数据是帮助指挥官与参谋理解作战环境、制定符合战略目标计划的关键支撑因素。在联合规划过程(JPP, Joint Planning Process)中,这些输入以参谋估计(staff estimates)的形式出现,应“同时考虑军事行动的可量化与非量化因素。它们将友军与敌军的力量、武器系统、训练、士气与领导力转化为战斗能力。”\({ }^{55}\) 参谋估计在JPP的任务分析阶段形成,并在COA开发阶段得到细化。

如图1-2所示,JPP完成后,参谋估计仍会在作战评估(Operational Assessment)阶段持续更新,部队在此阶段识别并分析作战环境的变化,以评估行动进展。这些动态评估(running estimates)构成了各参谋部门信息需求(IRs, Information Requirements)的基础,随后被进一步细化为指挥官关键信息需求(CCIRs, Commander’s Critical Information Requirements)。接着,各参谋部门的CCIRs被整合入COP。\({ }^{56}\) COP被定义为“在指挥官关注区域内、根据用户需求定制并由多个指挥部共享的相关信息显示。”\({ }^{57}\) COP有助于指挥官与参谋建立态势理解,并使不同指挥层级之间实现共享的态势认知——这正是陆军任务指挥(mission command)理念的核心要求。正如《陆军条令出版物6-0》(ADP 6-0)所述:“共享态势理解使指挥官能够可视化其决策对部队其他要素及整个行动的影响。任务指挥允许下级结合COP与指挥官意图,行使有纪律的主动权。”\({ }^{58}\)

COP的生成是一个以人为中心的过程。参谋人员依靠有经验的规划者与受训士兵,将来自多源的数据转化为参谋估计,再细化为IRs,缩减为CCIRs,并最终将CCIRs汇总进COP。利用AI的技术为这些活动(尤其是重复性任务)的自动化提供了可能,从而减轻参谋负担。

态势理解框架为不同职能与角色的组织提供了一种正式结构,使它们能将COP转化为指挥官的决策。\({ }^{59}\) 图1-7展示了从原始数据到指挥官决策的正式理解结构。\({ }^{60}\) “任务指挥”将态势理解描述为:对相关信息进行分析与判断,以确定作战与任务变量之间的关系。该框架提供了一种系统化方法,利用数据、信息与知识以实现态势理解。以下为关键术语定义:

- 数据(Data):由人类、机械或电子采集器检测的未经处理的观测结果。在典型组织中,数据通常从下属单位流向指挥所。下级部队上报数据,以帮助上级司令部了解有助于态势理解的事件。数据可以量化、存储并组织成文件或数据库,但只有在被处理为信息后才能发挥作用。

- 信息(Information):是经过组织与处理、为进一步分析提供上下文的数据。可用信息量的巨大,使得如何管理并有效利用信息成为行动成功的关键。指挥官与参谋通过经验与判断将信息转化为对事件与条件的共享理解,以支持作战期间的决策。有效的指挥与控制(C2, Command and Control)需要进一步将信息发展为知识,从而实现理解。

- 知识(Knowledge):是经过分析与评估、具有作战意义的信息。通过学习、经验、实践与人际互动所获得的理解,构成专业能力与判断力的基础。参谋部门致力于改进与共享隐性(tacit)与显性(explicit)知识。

- 理解(Understanding):是将判断应用于知识后形成的对局势内在关系的综合认知,用以支持决策与行动。理解是在特定情境中将判断应用于知识的结果,意味着对局势的掌握已足以通过行动改变它。判断基于经验、专业知识与直觉。理想情况下,真正的理解应成为决策的基础。然而,不确定性与时间限制往往使得在决策与行动前无法获得完全理解。\({ }^{61}\)

图1-7. 达成理解的过程

图1-7. 达成理解的过程

该框架在联合规划过程(JPP, Joint Planning Process)与军事决策制定过程(MDMP, Military Decision-Making Process)中有直接体现。例如,天气报告(原始数据)在被筛选为与某部队责任区相关的部分后,形成动态评估(running estimate)中的事实信息,此时即转化为信息。当分析人员评估严重天气警报的作战影响,并描述其对行动的风险及可能的行动方案(COA, Course of Action)应对时,这些信息又转化为知识。最后,指挥官将该知识与其他经验结合,形成态势理解(situational understanding),在共同作战图(COP, Common Operational Picture)中体现,并据此做出最佳决策。

该框架展示了机器学习(ML, Machine Learning)模型在JPP中的潜在应用方式。人工智能(AI, Artificial Intelligence)可用于原始数据的处理,以生成重复但重要的信息——例如,可将来自多源的天气数据进行预处理,使之具备相关语境,并自动预填入动态评估中。\({ }^{62}\) 进一步沿该框架推进,AI模型可通过分析严重天气信息与大量作战数据,生成知识、识别风险并提出供参考的COA。最后,指挥官可以将AI的推荐纳入决策,理解其依据(例如通过CCIRs和COP),并为部队选择最佳前进方向。\({ }^{63}\)

当前条令与流程的研究表明,生成参谋估计与COP的方法主要依赖受过训练的参谋人员,综合使用定性与定量数据源。这些数据格式与来源的差异显著影响数据科学家如何利用COP数据训练AI模型。定量数据源(如数值型数据)可用于采用统计型ML技术的模型训练。\({ }^{64}\) 相反,定性数据源(如文本材料)更适用于自然语言处理(NLP, Natural Language Processing)等方法,使计算机能够理解、处理与解释人类语言。\({ }^{65}\) 对若干战区部队的访谈估计,约85%的此类资料以幻灯片和白皮书形式存在。\({ }^{66}\) 尽管陆军鼓励使用数字化COP,但在联合作战层级,COP的应用仍主要为模拟形式,常采用Microsoft PowerPoint作为主要展示工具。\({ }^{67}\)

此外,参谋估计与COP的开发通常结合数字与模拟信息源。数字信息可来自用于任务规划的作战系统(如全球指挥与控制系统联合版 GCCS-J, Global Command and Control System–Joint),或用于武器状态信息的战术系统(如先进野战炮兵战术数据系统 Advanced Field Artillery Tactical Data System),这些信息可被聚合形成低层级作战图。而模拟信息可能来源于报告与文档,例如从指挥氛围调查中提取的部队士气,或口头交流内容。

最后,在态势理解框架中训练AI系统需要使用在条令上属于知识管理(KM, Knowledge Management)与信息管理(IM, Information Management)范畴的数据。根据《陆军条令出版物6-0》(ADP 6-0),“知识管理是促进知识流动以增强共享理解、学习与决策的过程”,而“信息管理则是利用流程与信息系统收集、处理、存储、显示、传播与保护数据、信息和知识产品的科学。”\({ }^{68}\) 因此,必须在联合指挥层级及参谋部门中对知识管理与信息管理进行调整,以建立训练AI所需的流程与产品。例如,用于动态评估的数据可能来源于数字系统(信息管理)与低层级参谋部门(知识管理)的结合。为了支持动态评估而开发AI模型,可能需要从这些数字系统中查询数据,并从其他梯队调用历史归档数据。

理解数据来源、COP生成过程(如参谋估计、信息需求IRs与关键信息需求CCIRs)及COP自身的结构,对于确定AI的数据需求至关重要。AI模型依赖数据进行训练,而理解当前JPP执行方式能为陆军提供洞见,帮助其确定应在何处投资以促进AI在COP中的应用。

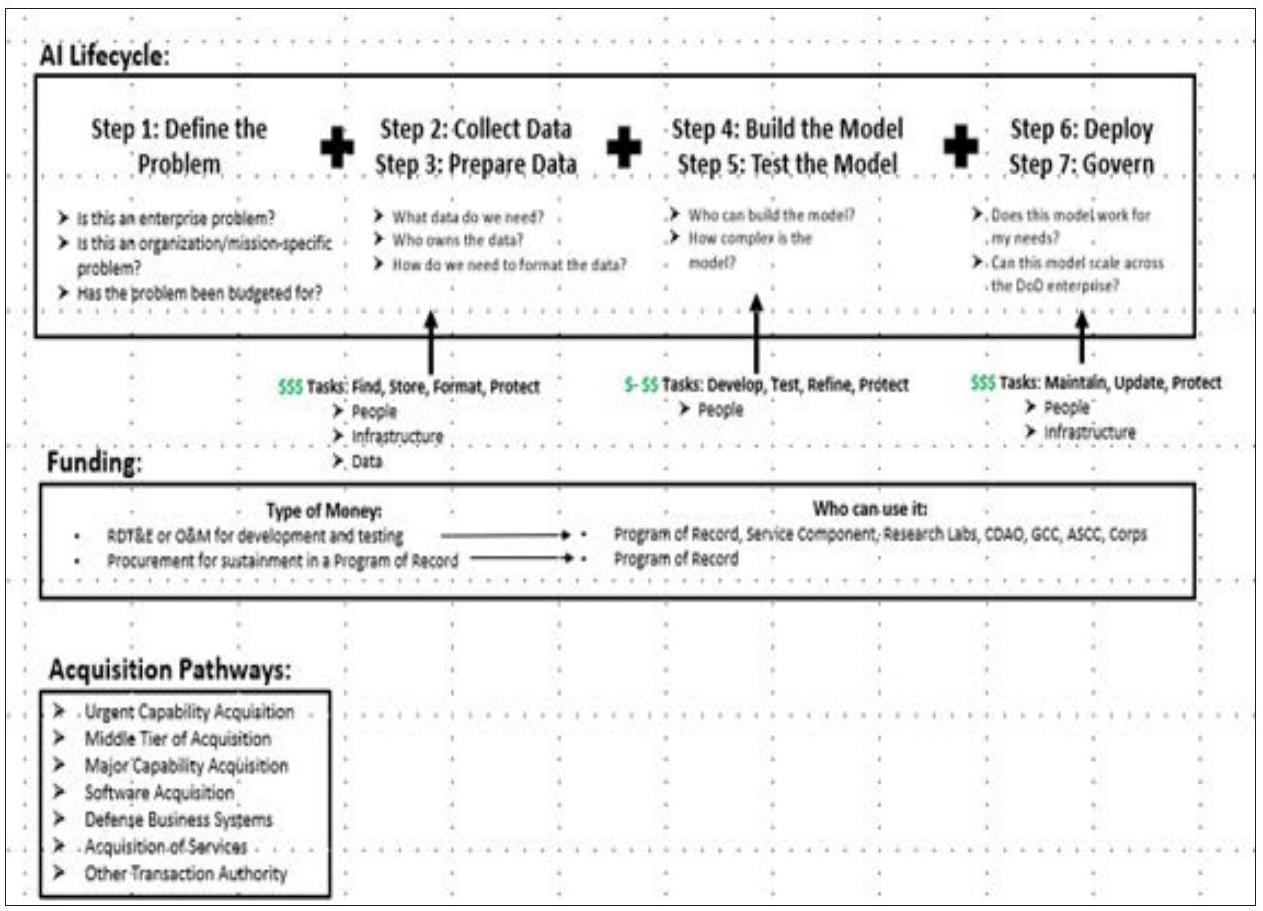

AI模型生命周期(AI Model Life Cycle)

对AI模型开发过程理解得越深入,就越能高效地收集与整理相关数据。AI模型生命周期如图1-8所示,展示了从概念化到实现与维护的通用步骤。简而言之,AI建模始于识别要解决的问题,随后收集并准备所需数据。数据科学家随后训练与测试模型。当模型性能达到可接受范围后,即可部署并在现实环境中持续运行。以下为AI模型生命周期的主要阶段:

- 步骤1:识别业务问题(Identify the business problem)。组织识别能力缺口,评估选项,并确定AI赋能能力的需求。

- 步骤2:收集数据(Collect data)。数据科学家确定需求、识别可用来源并开始数据收集。

- 步骤3:准备数据(Prepare data)。收集完成后,数据科学家开始将数据转换为可输入AI模型的可用格式。

- 步骤4:构建模型(Build model)。数据科学家开发并训练AI模型,尝试不同的训练技术。

- 步骤5:测试模型(Test model)。用未参与训练的数据集测试模型,对照预期行为评估其性能;若测试失败,则重新训练。

- 步骤6:部署(Deploy)。将训练好的模型部署到生产环境供实际用户使用。

- 步骤7:治理(Govern)。对模型进行持续维护与必要升级。当业务环境或趋势变化导致模型性能下降时,需重新训练。

图1-8. AI模型生命周期

图1-8. AI模型生命周期

除第一步外,数据收集与准备阶段是整个过程最关键的环节。在AI建模工作开始前建立坚实的数据基础至关重要。\({ }^{69}\) 这两个步骤往往揭示了AI在JPP中应用所面临的最突出问题。

数据收集(Data Collection)¶

进入参谋估计(staff estimates)与共同作战图(COP, Common Operational Picture)的数据和信息来源广泛,既包括定性数据,也包括定量数据。根据《联合出版物5-0》(JP 5-0),参谋估计应整合“友军与敌军的实力、武器系统、训练、士气与领导力。”\({ }^{70}\) 其中一些数据可来自数字化系统,例如武器系统信息可由“先进野战炮兵战术数据系统”(AFATDS, Advanced Field Artillery Tactical Data System)获取,该系统提供火力与效果规划、协调、控制与执行的自动化支持。\({ }^{71}\) 数据还可能来自“全球指挥与控制系统-联合版”(GCCS-J, Global Command and Control System–Joint)提供的地理位置信息,该系统为联合与多国行动提供了一个综合的、近实时的战场图像。\({ }^{72}\) 此外,数据也可能来自定性来源,例如对敌重心(center of gravity)或作战限制(operational limitations)的情报分析,这些内容界定了友军与敌军的约束条件。

多样化的数据源使得将数据汇聚至一个可用且统一的格式变得困难,尤其当部分数据仍以模拟形式存在时。为有效使用这些数据,各单位必须识别相关来源并将其导出至可访问的平台。鉴于不同数据可能具有不同的访问权限,组织必须建立高效机制,以确保敏感、机密与非机密数据源均能平等访问。一些系统(如AFATDS与GCCS-J)主要通过图形用户界面(GUI)提供信息,导出方式有限。定性数据可能存储在多个文档库中,数据收集者必须提交访问申请、获得批准并执行文档检索,才能评估数据的相关性。

此外,并非所有数字来源的数据都足以支持AI模型训练。例如,数据可能不可搜索、访问权限严格、缺乏描述性元数据、引用不可用的外部数据集,或数据已过时且来源不权威。为解决这些问题,美国国防部(DoD, Department of Defense)的《数据、分析与人工智能采纳战略》(Data, Analytics, and Artificial Intelligence Adoption Strategy)与《陆军数据计划》(Army Data Plan)确立了VAULTIS政策框架,以确保数据“可见(Visible)、可访问(Accessible)、可理解(Understandable)、可关联(Linked)、可信任(Trustworthy)、可互操作(Interoperable)与安全(Secure)”。\({ }^{73}\) VAULTIS框架为数据生产者与管理者提供了确保数据质量的方法,从而为AI能力奠定基础。

- 可见(Visible):使用者能够定位所需数据。

- 可访问(Accessible):使用者能够检索数据。

- 可理解(Understandable):使用者能够找到描述,以了解数据的内容、上下文与适用性。

- 可关联(Linked):使用者能够通过固有关系利用互补数据元素。

- 可信任(Trustworthy):使用者能够确信数据足以支持决策。

- 可互操作(Interoperable):使用者与生产者对数据的表达与理解一致。

- 安全(Secure):使用者知道数据受到未经授权使用或篡改的保护。

完全符合VAULTIS框架的数据会带有元数据(metadata),使用户能够轻松地搜索、收集与合并数据以进行准备工作——这对应AI模型生命周期的第3步(数据准备)与模型开发的第4步(建模)。\({ }^{74}\) 例如,一个为推荐COA而设计的AI模型可能需要从多个联合参谋部门、各军种组成部队及单位级参谋部门获取数据。执行数据收集的数据科学家需理解数据的可用性(可理解)、位置(可见与可访问)及使用方式(可关联、可信任与可互操作)。创建与维护使数据符合VAULTIS标准的元数据增加了数据生产者的工作量,并要求国防部中所有数据生产者获得足够的资源、培训与设备以遵循该框架。

数据分类在数据检索与模型训练中的应用中也带来显著问题。作战数据存在于多个分类级别,更敏感的信息(如系统作战性能或区域威胁)存储在更高密级中。在美军驻韩部队(USFK, United States Forces Korea)与美军印太司令部(USINDOPACOM, United States Indo-Pacific Command)的AI与ML项目中,一个共同特征是必须从多个安全分类级别中收集数据。\({ }^{75}\) 访问与汇集机密数据的困难在多个方面限制了AI模型的开发。首先,国防部在组织层面依赖承包商进行模型开发与数据管理,而拥有相应安全许可的合格承包商人数可能不足。其次,若AI工具或软件开发环境由商业供应商提供,它们可能无法在涉密网络上使用。这些问题限制了开发者可开展建模活动的场所与可访问的数据范围。

目前关于机密数据创建与处理的政策仍含糊且具限制性。《信息安全手册》(Information Security, DoD Manual 5200.01)规定了保密指导的要求与最低标准。此外,安全分类指南(SCGs, Security Classification Guides)为国防部系统使用的机密数据提供具体处理指导。\({ }^{76}\) 从多个领域汇集用于AI模型训练的数据将受“派生分类”(Derivative Classification)与“汇编分类”(Compilation)的约束。派生分类指“以新的形式整合、改写、重述或生成已被分类的信息,并根据源信息的分类标识对新生成的材料进行标注。”\({ }^{77}\) 而汇编分类指当信息要素组合后揭示出更高保密等级的信息。

AI模型需要大量数据,而现行政策可能限制可用的相关数据量。汇集的数据可能受多个SCG约束,若数据科学家不了解跨SCG的分类规则,会带来额外风险。更复杂的是,训练数据与模型算法可能同时受“程序性、数据性与作战性分类指导”的影响,因为特定AI能力的输出乃至存在,并不必然与输入数据或算法一一对应。\({ }^{78}\)

针对这些问题,国防部与陆军在AI相关SCG上的指导仍然不足。缺乏明确的安全分类政策,组织无法有效收集与准备数据。2020年国防部监察长报告指出,该部门缺乏指导以确保各军种在AI项目中遵循适当的安全保护。\({ }^{79}\) 因此,从事AI项目的工程师难以判断数据是否应处于更高的保密等级。两年后,为解决此问题,联合人工智能中心(JAIC, Joint Artificial Intelligence Center)建立了AI安全分类指南,但由于AI发展速度极快,部门最终认定无法制定统一的AI SCG。\({ }^{80}\)

相反,国防部选择制定全系统适用的AI分类原则,并将其附加至现有SCGs。尽管这些原则是进步,但尚未解决全部分类问题。若缺乏更明确的指导,数据科学家往往会采取更保守的方式,例如过度分类、避免使用机密数据源、或对数据进行过度模糊化处理。他们也可能在数据源与汇总时采用简化手段,以避免信息泄漏。这些做法将降低AI训练数据的质量,从而削弱AI模型的性能。

数据准备(Data Preparation)¶

在数据准备阶段,JPP中使用的许多数据与信息属于半结构化或非结构化文档。缺乏结构的数据难以用于AI,因为模型无法从中直接学习,必须进一步处理以提取有意义的信息。相反,结构化且带标签的数据更易于使用,所需处理与工作量较少,可直接用于AI模型训练。较少的数据准备工作使数据科学家能将精力投入到AI生命周期的其他步骤,如进一步的数据收集(步骤2)或模型构建与测试(步骤4与步骤5)。

AI模型可基于结构化、半结构化或非结构化数据构建。但结构化数据最易准备且适合AI模型开发;半结构化与非结构化数据则需额外处理与不同技术。结构化数据遵循标准化格式,以实现高效访问。\({ }^{81}\) 这种标准化使数据更易理解与调用。结构化数据示例包括电子表格、关系型数据库、网页表单结果与库存管理系统。

非结构化数据(unstructured data)则是不按既定模型或架构组织的信息。\({ }^{82}\) 非结构化数据缺乏标准格式,机器难以读取、解析与使用。典型示例包括图像、语音留言与视频。半结构化数据介于二者之间,不完全遵循标准结构,但包含描述性标记,用于说明数据内容。典型示例包括电子邮件、网页与社交媒体帖子。

如前所述,大多数参谋估计与COP采用简报文档形式,结合来自传感器的定量数据与报告类的定性数据。传感器与军用系统提供的定量数据多为结构化数据,所需处理较少;而定性数据则需经过转换与标注才能用于AI训练。此外,尽管JPP产品在格式上注重可读性与展示性,但条令与训练手册中提供的作战规划模板仅具半结构化特征,各部分内容定义宽松。许多参谋部门仍以Microsoft PowerPoint维护其COP,使得将其用于AI训练更加困难。当所有收集的数据合并用于训练时(包括传感器、系统、报告与简报文件),问题尤为突出。合并后的结构化、半结构化与非结构化数据难以被机器检索、解析或读取,在用于AI开发前需进行大量准备。\({ }^{83}\)

数据标注(Data Labeling)¶

即便找到所需数据,其质量也可能不足以支撑模型训练。数据标注(data labeling)是对原始数据(如图像、文本或视频)进行识别并添加有意义标签的过程,以提供上下文供ML模型学习。\({ }^{84}\) 在某些AI训练(如监督学习 supervised learning)中,标注数据是必需的。准确标注的数据可帮助模型学习区分正确与错误输出的模式,从而在处理未标注数据时生成高精度结果。因此,数据标注是数据准备过程中的重要环节。

然而,国防部尚未具备足够的能力执行数据标注以支持JPP。2022年美国政府问责署(GAO, Government Accountability Office)发布的关于武器系统AI应用的报告指出,该部门缺乏用于AI系统训练的准确标注历史数据。\({ }^{85}\) 由于JPP产品通常为非结构化或半结构化形式,它们往往缺乏教导LLM(大型语言模型, Large Language Model)区分“优秀参谋估计”与“低质量估计”的标注,或无法表明哪些报告被纳入COP。此外,美国国防高级研究计划局(DARPA, Defense Advanced Research Projects Agency)在同一报告中指出,当数据集过大时,数据标注任务的难度极高。期望AI模型基于大规模数据集训练在现实中并不合理,因为标注过程耗时且资源密集。

模型在共同作战图与行动方案开发中的集成¶

尽管AI与ML存在局限,但它们在军事作战规划中具有变革性潜力。而这种潜力的实现,在很大程度上依赖政策改进而非新技术本身。仅仅通过采用基本的、狭义的反应式AI来标准化并自动化参谋流程(如数据过滤与参谋产品自动化),即可显著缩短整合各类报告与估计以生成COP与COA所需的时间。未来,AI与ML可能基于趋势生成洞见或识别人工难以察觉的异常。然而,陆军必须首先建立准确数据的存储与传输系统。如果无法理解模型生成输出的过程,参谋仍需全面验证,从而抵消前端节省的时间。以下讨论了当前AI与ML技术如何融入规划流程。

共同作战图(Common Operational Picture)¶

国防部的总体战略旨在创建作战环境的共享理解并实现决策优势。《全域联合指挥与控制战略》(JADC2, Joint All-Domain Command and Control)提出了一个包含三步的指挥控制循环:“感知(sense)—理解(make sense)—行动(act)”。\({ }^{86}\) 该战略强调在“理解”阶段使用AI、ML与预测分析技术,从传感基础设施中“提取、整合与处理海量数据与信息”。\({ }^{87}\)

在JADC2架构下,陆军“指挥、控制与通信-战术项目执行办公室”(PEO C3T, Program Executive Office Command, Control, Communications–Tactical)负责开发“指挥所计算环境”(CPCE, Command Post Computing Environment)这一基于服务器的软件系统,用于支撑营至军团级指挥官与参谋在作战过程的各阶段协同生成COP。\({ }^{88}\) 初期测试与评估显示,CPCE第一阶段具备作战效能,能跨单位与梯队共享COP与相关数据;但2022年评估认为其“作战适用性不足”,问题包括系统可靠性低、终端用户培训不足与通用可用性差,尤其高级功能表现不佳。\({ }^{89}\)

在JADC2战略下提升CPCE的功能与互操作性已具挑战性,而进一步整合AI与ML以生成COP则更为困难。必须先建立基础设施,以从不同组织与系统生成并汇聚相关数据。这些数据在用于AI与ML模型开发或仪表板展示前,必须经过存储与整理。\({ }^{90}\) 可以说,除了地图外,COP中最关键的两个因素是友军与敌军态势。

友军态势可通过“联合战斗指挥平台”(JBC-P, Joint Battle Command–Platform)实现整合。该系统是“21世纪部队指挥旅及以下/蓝军跟踪系统”(FBCB2/BFT, Force XXI Battle Command Brigade and Below/Blue Force Tracking)的升级版,安装在超过12万台陆军装备上。\({ }^{91}\) 这些系统生成的数据需输入CPCE用于COP生成,并按使用梯队的精度需求进行分层。但规划者与指挥官不仅需要单位位置,还需掌握部队的作战与任务能力状态。这些信息来自不同系统与不同密级的报告,增加了复杂性。

敌军态势、状态与能力信息则由多源情报报告与传感器融合而来,挑战更大。传统上,情报报告与传感器的原始数据经情报单元处理、利用与分发(PED, Processing, Exploitation, and Dissemination)后形成“共同情报图”(Common Intelligence Picture, CIP)。\({ }^{92}\) 此流程会产生延迟,影响高节奏作战与COP时效。若直接将未经验证的原始数据输入COP以加快信息流,可能造成信息杂乱或展示错误内容。情报单元负责维护CIP,其系统必须与COP对接,以实现对更广情报图景的访问。\({ }^{93}\) 两者系统应同步查询与更新,以实现“单一视窗”(single pane of glass)目标。

Palantir Technologies开发的“梅文智能系统”(MSS, Maven Smart System)是一种用于快速间接火力任务目标生成的用户界面。\({ }^{94}\) MSS可整合用于跟踪航空器与监控后勤的数据流。\({ }^{95}\) 其计算机视觉能力来自“梅文项目”(Project Maven),该项目隶属于国家地理空间情报局(NGA, National Geospatial-Intelligence Agency)。AI与ML模型驻留于该机构内,并根据终端用户与分析师反馈定期再训练与更新。\({ }^{96}\) 这些模型识别有限类别的目标,并基于原始传感器数据自动分类与标注。MSS提供查询特定地理围栏区域的界面,并在COP上生成目标图标。用户可查看图像以确认AI识别结果,再执行火力任务。

MSS还包含一些利用AI能力的用户应用,例如社交媒体爬取器,用于在特定地理区域搜索关键短语,从发布的评论、图片与视频中执行战后损伤评估(BDA, Battle Damage Assessment)。\({ }^{97}\) 但流程仍需人工操作。NGA的梅文AI目前仅支持有限类别的目标识别,新目标与作战环境需重新训练模型。\({ }^{98}\) 系统允许部分误检(false detections),宁可出现少量误报(false positives)也不遗漏目标。使用MSS界面时,终端用户必须手动指定兴趣区域,确认图像正确,并将对象图像与来自其他传感器或源(如电子情报ELINT与信号情报SIGINT)的信息交叉验证以确认目标。\({ }^{99}\) 即便如此,第十八空降军团(XVIII Airborne Corps)借助梅文项目与MSS,每小时可处理多达80个目标,而传统方法仅能处理约30个。\({ }^{100}\) 即使存在限制,用户仍可创新。例如,第十八空降军团与Palantir正在尝试让MSS根据炮管使用率推荐射击方案,并预测弹药消耗率以支撑后勤规划。\({ }^{101}\) 然而,这些功能尚未正式部署。

如前所述,指挥官的COP需求具有语境敏感性,取决于指挥官与参谋处理与共享信息的方式。虽然使用AI与ML填充COP可能带来信息过载风险,但同时也能支持针对特定任务或作战的定制化显示。这些技术还可加速信息更新与流程执行,从而提升决策速度。AI与ML的重点应放在加速并优化生成COP的信息流,而非直接生成COP本身。采用“低代码/无代码”(low-code/no-code)方案,使具有限编程经验的用户能调整系统功能并开发小型AI/ML模型以定制COP,将进一步提高灵活性。

数据过载与人力不足问题在多个领域尤为突出,尤其是情报部门——在图像与视频处理方面。\({ }^{102}\) 仅在自动化图像识别与目标检测中应用AI与ML,即可大幅加速COP生成与决策,如第十八空降军团与NGA的梅文项目所示。进一步地,在前线传感器或平台上部署AI与ML模型以实现边缘目标识别(on-edge identification),仅传输网格位置与静态图像供人工验证,可为COP提供近实时的情报与态势理解。\({ }^{103}\) 同时,若能自动融合其他情报源(如测量情报MASINT与信号情报SIGINT),AI与ML可提升识别可信度、加快敌目标识别并避免因单一传感类型被敌规避。最终结果是:更精准的COP支撑更高质量的决策。

行动方案(Courses of Action)¶

图1-9展示了MDMP(军事决策制定过程, Military Decision-Making Process)中的时间分配示例。\({ }^{104}\) 其中有一半时间用于COA(行动方案, Course of Action)的制定、分析与比较。可用时间的限制常常使规划人员难以为某次行动生成多个“可行、可接受、适当、可区分且完整”的COA。引入AI有潜力显著缩短MDMP各环节所需时间,同时在相同时间内生成更多、更完整且分析更充分的COA。

| 执行前可用时间 | ||||||||||

|---|---|---|---|---|---|---|---|---|---|---|

| 8小时 | 24小时 | 48小时 | 72小时 | 96小时 | ||||||

| 时间分配 | R+ | 时间分配 | R+ | 时间分配 | R+ | 时间分配 | R+ | 时间分配 | R+ | |

| 任务分析 | 0:45 | 0:45 | 2:24 | 2:24 | 4:48 | 4:48 | 7:12 | 7:12 | 9:36 | 9:36 |

| COA制定 | 0:30 | 1:15 | 1:36 | 4:00 | 3:12 | 8:00 | 4:48 | 12:00 | 6:24 | 16:00 |

| COA分析与比较决策 | 0:45 | 2:00 | 2:24 | 6:24 | 4:48 | 12:48 | 7:12 | 19:12 | 9:36 | 25:36 |

| 命令生成 | 0:30 | 2:30 | 1:36 | 8:00 | 3:12 | 16:00 | 4:48 | 24:00 | 6:24 | 32:00 |

| 总计 | 2:30 | 8:00 | 16:00 | 24:00 | 32:00 | |||||

| COA行动方案 R 接收任务时间 |

图1-9. 规划时间表示例

当前AI与ML(机器学习, Machine Learning)技术在军事规划的科学部分中能发挥重要作用。\({ }^{105}\) 即便是自动化诸如绘制军事符号等简单任务,也能节约大量时间。尽管条令认为COA制定更偏向“艺术”而非“科学”,但其中的若干步骤确有科学特征,可通过AI与ML部分自动化或加速执行,或揭示规划人员在复杂环境中难以察觉的潜在规律。例如,战斗力评估过程相对直观。若提供某梯队下两级的友军与敌军机动部队数据,规划人员即可通过对比强弱估算兵力比(force ratio)。此类数值关系随后结合士气、训练差异、指挥员能力等主观因素,形成综合战斗力评估,从而揭示友军与敌军的脆弱点、所需资源及可行的进攻或防御类型。\({ }^{106}\)

在作战层面,美国印太司令部(USINDOPACOM, United States Indo-Pacific Command)正在开发“风暴破坏者联合作战规划工具包”(STORMBREAKER Joint Operational Planning Toolkit)。该AI驱动软件旨在增强作战规划人员能力,并实现JPP(联合规划过程, Joint Planning Process)的自动化,尤其面向中长期作战规划。印太司令部希望借此将作战计划的制定时间从24个月缩短至24天,使经审查批准的COA数量提升一个数量级,并构建一个完备的COA与作战计划库,供参谋与指挥官在危机时快速调用或改编。\({ }^{107}\) 在其最终形态中(见图1-10),STORMBREAKER将能够利用条令、联合数据集与自身COA库,支持规划人员开发、分析、兵棋推演(wargame)并比较COA以供审批。\({ }^{108}\)

图1-10. STORMBREAKER设计示意图

图1-10. STORMBREAKER设计示意图

STORMBREAKER是一项庞大工程。通过应用程序接口(API, Application Programming Interface),它将类似仪表板的图形用户界面(即联合作战规划工具包)与信息环境指控系统数据仓库及用于作战判定的建模与仿真引擎连接起来。\({ }^{109}\) 在装备数据方面,STORMBREAKER分别从友军与敌军能力的权威数据库中获取信息,甚至会调用来自Janes和Wikipedia等开源资源的数据。该工具将这些能力以单一装备对象形式可视化,而非原始数据形式。

STORMBREAKER还利用建模与仿真能力“在AI/ML视角下评估并生成基于现有威胁数据、友军数据与作战计划的输出。”\({ }^{110}\) 截至2023年,系统仍处于交付早期阶段。当时STORMBREAKER主要表现为一个内置数据检索工具的仪表板,用于协助规划人员开发COA,尚未整合ML能力。\({ }^{111}\) 但即便凭借有限的数据功能,该工具已能让规划人员更快地生成与评估更多COA,显示出随着AI功能完善,其性能将迅速提升。

商业公司也在积极探索COA开发问题。在2020年SPIE《国防与商用传感》会议上,研究人员展示了一款用于兵棋推演阶段的软件工具,可推荐COA改进方案。尽管该工具不会自动生成COA,但它允许用户输入友军与敌军的COA,并通过指挥控制通信、计算机、情报、监视与侦察(C4ISR)仿真基础设施(Data Analysis and Visualization INfrastructure)进行评估,AI与ML随后提出友军COA调整建议。其独特之处在于该系统“考虑到作战现实,包括AI训练数据匮乏、战术计算资源有限以及需要用户在COA分析全过程中交互参与。”\({ }^{112}\) 虽然该工具利用AI/ML识别复杂多域环境中被忽略的机会或风险,但并未显著减少规划与决策时间。

一篇题为《COA-GPT:用于加速军事行动方案开发的生成式预训练变换模型》(\(COA\)-\(GPT\): Generative Pretrained Transformers for Accelerated Course of Action Development in Military Operations)的论文提出了一种创新算法,利用商用LLM(大型语言模型, Large Language Model)(如OpenAI的GPT-4 Turbo及GPT-4 Turbo with Vision)在后台快速生成模拟军事交战的COA。\({ }^{113}\) 该技术标志着AI在COA开发领域的重要突破,有望显著减少COA生成与评估时间,提升决策效率。

COA-GPT算法构建于其他LLM在战略规划与交互学习方面的创新基础之上,如DisasterResponseGPT、Voyager与STEVE-1。DisasterResponseGPT利用LLM快速制定灾害应对行动计划,并将关键指南直接嵌入提示中。\({ }^{114}\) Voyager代表了自主智能体领域的重大进展,展示了LLM在《我的世界》(Minecraft)动态环境中实现持续学习与技能发展的潜力。\({ }^{115}\) 类似地,STEVE-1模型展示了LLM如何在虚拟环境中引导智能体执行复杂指令,结合了文本驱动图像生成与决策过程的最新进展。\({ }^{116}\)

在初步生成COA时,COA-GPT允许规划人员以文本与图像形式输入任务与兵力部署详情。通过在系统提示中嵌入领域知识与军事条令,该系统可在数秒内生成与战略相符的COA。软件将输出的COA转化为可视化图示,并附上任务概要供人工审阅。COA-GPT并非全自动流程,它允许人类规划者通过追加提示与反馈来优化AI生成的COA。美国陆军战斗能力开发司令部(DEVCOM, US Army Combat Capabilities Development Command)的研究人员使用基于《星际争霸II学习环境》(StarCraft II Learning Environment)构建的“虎爪行动”(Operation Tiger Claw)场景对COA-GPT性能进行了评估。\({ }^{117}\)

《星际争霸II》是一款复杂的即时战略游戏,要求玩家同时进行宏观经济战略与微观单位管理。其庞大的状态与动作空间、持续时间、实时决策机制及“战争迷雾”带来的不确定性,使其成为研究多域作战(MDO, Multi-Domain Operations)中指挥控制AI的理想测试平台。\({ }^{118}\) “虎爪行动”由佐治亚州摩尔堡(Fort Moore)专家设计,模拟第12骑兵团第1营攻击穿越瓦迪塔尔萨河(Wādī Tharthār)并夺取“狮子目标”(Objective Lion)。该场景基于军事条令,详细描述了友军与敌军作战计划,被集成入《星际争霸II》,为神经网络设计与奖励机制研究提供了标准化环境。\({ }^{119}\)

研究人员将COA-GPT与两种现有算法(单人示范自对策强化学习Autocurriculum RL与异步优势演员评论家A3C, Asynchronous Advantage Actor-Critic)以及人工专家(SME, Subject Matter Expert)进行了对比。\({ }^{120}\) 研究在多种设置下测试COA-GPT,包括有人反馈、无反馈、仅文本输入与文本+图像输入。

AI与ML模型训练与测试均需设计奖励函数(reward function)以实现优化。在“虎爪行动”场景中使用的奖励函数包括:(1)总得分奖励,用于奖励推进、惩罚撤退;(2)损失最小化,即减少友军损失;(3)敌军歼灭,即最大化敌方消灭数量。研究人员为三种基准算法与每种COA-GPT配置共执行50次滚动实验,并对各方法在每个奖励函数下的平均值与标准差进行评估。\({ }^{121}\)

实验结果显示,AI与ML的LLM在COA开发与评估中表现出可观潜力,但也暴露出技术限制。在三个性能指标中,COA-GPT平均表现优于其他AI基线模型,但人工专家(SME)仍优于所有AI组合——取得更高的总得分、更多的敌军歼灭与更少的友军损失。研究人员认为,这源于人类专家能在模拟中持续调整以应对敌行动,而COA-GPT仅在开始时生成一次性战略命令并全程执行,未再输入。这凸显了“持续作战过程”在COP支持下的重要性。COA-GPT原型具备与战场实时传感器数据接口并接入兵棋推演模拟器的潜力,以实现快速COA分析与比较,但论文未展示此功能。\({ }^{122}\)

COA-GPT展示了利用商用GPT并调优以服务军事功能的潜力。然而,它也存在局限。其针对特定场景、固定地形与标准化兵力结构设计,仅在仿真/游戏环境中运行。现实世界远比其复杂与动态。此外,COA-GPT每次仅生成一个COA供指挥官与规划者经提示优化,而非如MDMP或ADM(陆军设计方法, Army Design Methodology)中那样提供多个COA及兵棋推演结果以供比较。要真正具备动态能力,完全任务化的COA开发工具必须能处理来自COP与实时传感器的输入。在真实环境中,用户需基于历次冲突、兵棋结果与不同保真度的仿真数据对AI/ML进行训练,以建立可用于推荐实际COA的关联。研究人员已意识到这些问题,并计划在未来研究中加以改进。\({ }^{123}\)

AI与ML模型具备将数百名军事指挥官与规划者的经验和知识汇聚于一体的潜力,且不受人员更替与记忆丢失影响。若能实现这一技术突破,将赋予掌握此能力的一方压倒性优势。LLM与GPT的快速进展是AI/ML领域最具潜力的突破之一。值得注意的是,最前沿的AI研究主要发生在商业部门,而非国防部。因而,与传统武器系统不同,先进AI/ML技术更可能呈现“军民两用”(dual-use)特征。\({ }^{124}\) 国防部《数据、分析与人工智能采纳战略》明确指出:“仅当应用能够服务于特定国防任务且无法直接采用现有商业解决方案时,国防部才会自行开发系统。”\({ }^{125}\) 而作战决策——COA开发的核心——正是此类任务中最具国防专属性的部分。

目前商用LLM尚不足以支持COA开发。它们虽能汇总大量信息,但摘要结果易受算法偏差影响,且准确性高度依赖训练数据。更大的LLM甚至开始“自我污染”(training their own exhaust)——即机器互相学习自己生成的内容。\({ }^{126}\) 尽管如此,国防部仍应继续探索商用LLM及其他AI/ML方案在COA开发中的应用,并可在受控的实训环境(如欧文堡国家训练中心 Fort Irwin National Training Center 与机动作战训练中心)中,将COA-LLM与类似模型与真人对抗测试,以评估性能。

规划者与指挥官应认识到:AI或ML模型无法生成完美的COA或确定终态。正如统计学家George Box所言:“所有模型本质上都是错的,但有些是有用的。”\({ }^{127}\) 由于AI与ML依赖大规模数据关联与模式匹配,它们擅长识别异常模式。领导者必须理解“错误数据会造就错误模型与输出”。用户应将AI/ML结果与其他信息交叉验证以确保准确性。在COA开发中,AI与人工并非“非此即彼”的选择,最佳做法是人机协作(human-AI teaming)——利用AI弥补人类弱点并放大人类优势。

与COP类似,AI与ML可作为参谋规划者的虚拟助手。结合AI、ML与自动化技术能在人工生成COA的同时节约大量时间。要充分发挥AI/ML的潜力,军人需掌握提示工程(prompt engineering)技能,以最大化模型功能与协作效果。STORMBREAKER、COA-GPT及其他AI/ML COA开发技术正推动智能化规划体系的发展。尽管LLM与生成式AI热度高涨,但除非出现颠覆性的计算与AI突破,近期内的趋势仍将是“人机融合”,而非“纯AI决策”。

数据支撑:通用作战图(COP)与行动方案(COA)制定¶

如前所述,模型的性能取决于其训练数据的质量。鉴于陆军在AI模型训练可用数据方面的缺口,陆军应采取若干措施来应对、缓解或最小化风险。这些建议旨在降低AI建模的进入门槛。数据收集与准备始终是组织问题识别后的必要环节。预先部署的能力(如支持VAULTIS框架的数据处理工具或可执行自动化数据转换的系统)可加速数据收集与准备步骤,从而使数据科学家在项目生命周期的早期即可开始模型训练。以下为具体建议步骤:

- 建立作战数据网格(Operational Data Mesh),包括围绕“数据即产品(data-as-a-product)”的概念与流程,并明确领域责任人(domain owner)的职责。\({ }^{128}\)

- 制定数据掩蔽(data masking)政策与技术能力,以去机密化大量数据。数据掩蔽是一种通过打乱数据来保护其安全的数据安全技术。\({ }^{129}\)

- 投资于用于作战数据的合成数据(synthetic data)生成技术。

- 制定更多条令化标准与工具,以进一步定义参谋评估与COP数据结构并自动化流程。

作战数据网格(Operational Data Mesh)¶

当前,数据需求、VAULTIS数据缺失与标准化不足的结合,使得在联合规划过程(Joint Planning Process, JPP)中搜索、定位与收集可用于建模的数据极为困难。国防部与陆军提出的解决方案之一即为实施“数据网格”概念。数据网格是一种分散式数据架构,按特定领域(如财务、后勤等)组织数据,使数据生产者能独立制定文档、质量与访问策略,而数据使用者可自由搜索并按需使用。\({ }^{130}\) 数据网格旨在为使用者提供便捷、安全、高质量的数据访问,同时确保数据生产者保有数据所有权。一个高效的数据网格应遵循以下四项基本原则:

- 领域驱动的分布式架构(Domain-driven distributed architecture):领域团队拥有数据,并可按需准备。

- 数据即产品(Data-as-a-product):数据生产者开发并提供满足内外部消费者需求的产品。

- 自助式数据基础设施(Self-service data infrastructure):自助平台使数据生产者可提供数据产品,消费者可独立搜索与请求访问。

- 联合治理(Federated governance):治理确保符合企业与监管政策,维护数据产品的安全性、质量、标准化与互操作性。\({ }^{131}\)

实施数据网格对于支持机器学习(Machine Learning, ML)项目至关重要。IBM在一篇文章中指出:“通过标准化与领域无关的数据,数据科学家可更容易地整合来自不同来源的数据,从而减少数据处理时间。这将加速模型进入生产环境的数量,推动自动化目标实现。”\({ }^{132}\) 国防部首席数字与人工智能办公室(Chief Digital and Artificial Intelligence Office, CDAO)与陆军助理部长(采办、后勤与技术, ASA(ALT))均已认识到数据网格对AI建模的重要性。2023年10月,CDAO开始寻求商用数据网格解决方案,以建立一个“提升数据可见性、简化数据连接并自动化数据访问”的通用数据网格。\({ }^{133}\) 陆军则通过“统一数据参考架构”(Unified Data Reference Architecture, UDRA)推动数据网格建设,由ASA(ALT)领导,指导陆军各项目接入企业级数据网格。该助理部长计划构建一套“即插即用的数据基础设施,使陆军能够释放目前仍被系统锁定的大量数据。”\({ }^{134}\) 目前,相关项目仍在识别阶段。尽管架构实施尚处早期,但其目标是涵盖系统生成的数据产品与作战数据产品。\({ }^{135}\)

为确保陆军与国防部数据网格实施的同步性,作战单位必须在UDRA早期阶段参与。目前公开资料尚未显示作战单元或参谋部门参与了数据网格试点或讨论。然而,使作战利益相关方早期参与至关重要,因为在数据网格架构下,参谋部门既是主要的数据生产者,又是主要的消费者。参谋部门已在多个Microsoft SharePoint实例与文档库中生成大量信息。这些信息可按“数据即产品”原则打包并列入数据网格目录(catalog)。目录使参谋部门能作为数据消费者运行查询,以提取与运行评估和COP相关的数据。最后,让作战代表参与治理过程,能确保数据网格满足部队与战区指挥官的作战需求。

在开发新的AI模型时,当问题与AI能力需求已被确定,组织即可开始数据收集。借助数据网格,这些组织可作为数据消费者,搜索、定位并申请所需的系统与作战数据产品。初步收集后,部分数据可能无法直接使用。由于数据生产属于领域责任人职责范围,数据收集者可与生产者协作,提出新的数据产品需求,以满足AI模型训练要求。

此外,数据网格还促进了两个关键需求:可追溯性(traceability)与模型再训练(model retraining)。根据国防创新委员会(Defense Innovation Board)提出的AI伦理原则,AI必须具备可追溯性,即“相关人员应具备对AI技术、开发流程与作战方法的适当理解,包括可审计的方法论、数据来源与设计文档。”\({ }^{136}\) 数据网格的领域所有权原则使AI模型开发者能追溯到创建数据产品的组织。这与传统集中式数据湖(data lake)不同,后者的数据所有权往往与生产者脱节。\({ }^{137}\)

更重要的是,数据网格简化了模型再训练过程。AI相较于静态代码的一大优势即为可再训练性。\({ }^{138}\) 模型再训练通常在数据不足或数据动态变化的环境中进行。在这两种情况下,数据网格中的生产者可更新其数据产品。例如,参谋作为数据生产者,可能在运行评估中发现新的风险,可将数据(包括识别风险的情报需求IRs)打包并提供给数据科学家,用于重新训练支撑JPP的AI模型。

尽管数据网格看似易于实施,即便作战规划人员认同该理念,仍需进一步研究与澄清。目前尚不清楚作战数据将由谁、以何种方式制作为数据产品。对参谋部门而言,直接打包数据并将准备工作交由消费者更为省力;但消费者可能缺乏足够的领域知识。例如,作战规划人员更适合将风险数据与天气、地形等因素关联并标注,而数据科学家可使用SuperAnnotate或Amazon SageMaker Ground Truth等标注工具以优化准备流程。\({ }^{139}\) 最优方案可能取决于数据产品类型及负责组织的资源分配。但在治理初期明确这些问题至关重要。

数据分级(Data Classification)¶

数据分级是AI模型训练中组织必须持续关注的主要挑战。AI模型开发应在非限制性环境(permissive environment)中进行。安全的、非机密的软件开发环境允许最大限度地利用最新AI技术、API与库。训练好的AI模型可在具备网络安全防护(如网络扫描与运行许可)的前提下导入更高密级环境。然而,软件开发与模型训练仍依赖于现实的非机密作战数据。为此,应研究可移除大规模数据中敏感信息的数据掩蔽政策与技术。同时,陆军应投资于能生成高度逼真合成作战数据的技术,以便在不触及敏感信息的情况下进行模型训练。

数据掩蔽(Data Masking)¶

通过宽松的去机密化政策与数据掩蔽技术,可增加可用的非机密现实数据量。数据掩蔽(又称混淆,obfuscation)通过修改数据的原始字符与数字来隐藏敏感信息,从而满足安全与隐私要求。\({ }^{140}\) 该领域在医疗行业尤为重要,因《健康保险携带与责任法案》(HIPAA)等法规对个人身份与健康信息有严格保护。多种数据掩蔽技术可确保在保持合规的前提下进行AI训练,例如:

- 标记化(Tokenization):将敏感数据替换为占位符或标记以掩盖敏感性。例如,可用唯一的非特定标识符替换部队名称。

- 格式保持加密(Format-preserving encryption):在加密数据的同时保持其与现有系统的兼容性。

- 数据编辑(Data redaction):允许从文档或图像中选择性删除敏感信息。

- K-匿名(K-anonymity):修改数据,使数据集中所有记录共享相同属性,从而难以识别特定元素。\({ }^{141}\)

这些技术同样可应用于作战数据。参谋评估、COP及其数据源往往包含不同密级的混合数据。部分数据可通过掩蔽处理后满足去机密化标准。若使用能处理大规模信息的软件工具,可实现掩蔽数据集的去机密化,从而在非机密AI环境中用于训练。陆军在数据掩蔽与AI数据集去机密化方面的投资将带来长期战略收益,显著扩大训练数据可用量。

然而,仅靠技术方案不足,还需在安全分类指南(Security Classification Guides, SCGs)层面放宽政策,以允许适当去机密化。这将是最具挑战的部分。来自多源的数据集合可能同时受多份SCG约束,而这些指南间的规则往往矛盾或不充分。因此,判定哪些数据应掩蔽及采用何种技术将十分困难。为解决这一问题,陆军应与CDAO协作,并根据国防部情报与安全副部长的建议,制定“AI分类原则(AI Classification Principles)”,使部分AI项目可附加至现有项目或能力的SCG中。\({ }^{142}\) 新修订的指南应明确规定数据集去机密化的政策与细节。

数据集去机密化无论在政策或技术层面都存在局限。首先,数据掩蔽最适用于结构化数据(structured data),因其规则清晰、易于处理。例如,从电子表格中删除高优先级目标名称较为简单;而半结构化与非结构化数据则存在更大挑战。尤其是多数参谋评估与COP数据本身即属半结构化或非结构化。一些研究者已尝试使用ML与自然语言处理(Natural Language Processing, NLP)对非结构化数据执行掩蔽算法。IEEE在2020年发表的一项研究表明,经过最小训练后,模型可在掩蔽敏感政府数据时达到约90%的准确率(精确率与召回率)。\({ }^{143}\) 虽然该技术尚不成熟,暂不适用于机密作战数据,但为国防部提供了潜在投资方向。

另一个限制在于:基于去机密化数据训练的AI模型可能表现出“涌现行为(emergent behavior)”,从而意外泄露机密信息。涌现行为指“由简单规则或元素相互作用产生的复杂行为,而非通过显式编程定义。”\({ }^{144}\) 数据科学家尚难以解释这类行为产生的原因。\({ }^{145}\) 即便数据已掩蔽,其字段间的隐含关联仍可能泄露敏感信息。例如,部队状态报告的数据来源于非机密系统,但一旦汇总并赋予战备等级,其简报即属“机密”并存储于SIPRNet。若使用商用LLM分析这些系统,必需连接更大的商用网络,这可能导致外部实体通过查询预测美军战备状态,如从维修零件订单推断炮管完好率。

再如,一个旨在加速联合火力支援规划的模型,可能无意中暴露情报、监视与侦察(ISR, Intelligence, Surveillance and Reconnaissance)资产的能力,即使未使用相关数据进行训练。这可能源于其从友军、威胁与目标位置、战损评估及其他数据间的相关性中学到的模式。

尽管存在这些限制,数据掩蔽仍是一种强有力的工具,可为数据科学家提供更多AI训练数据。陆军可将去机密化数据的范围限定于结构化、格式严格的作战数据集,以避免产生机密涌现行为。例如,后勤数据通常运行在非机密网络上,但在转化为CCIR(指挥官关键情报需求, Commander’s Critical Information Requirements)与COP过程中可能被提升至更高密级。

合成数据(Synthetic Data)¶

当可用于AI模型开发的数据不足时,一种替代性方法是创建类似于真实世界数据的人工数据,这种技术通常被称为“合成数据生成”(synthetic data generation)。合成数据生成的目标是产生新数据,而不是收集现有数据,使AI建模能够在其上进行训练,从而获得与在真实数据上训练相似的性能。\({ }^{146}\) 例如,如果一个AI模型缺乏足够的目标数据进行训练,则可以通过合成数据人工生成敌方目标(如坦克)在各种天气条件、不同时间、甚至从多个角度的图像。\({ }^{147}\) 举例而言,如果需要更多某种环境中坦克的图像,可以利用三维模型在不同光照和背景条件下、不同角度下生成图像,从而在没有真实照片的情况下训练模型。合成数据技术使数据科学家能够按需、以特定数量、根据精确规格数字化生成所需数据。\({ }^{148}\) 合成数据具有以下三大主要优点:

- 质量:数据收集和准备通常需要大量资源用于纠错、标准化和标注。合成数据可确保更高的数据质量、平衡性和多样性。人工生成的数据可以自动填补缺失值并添加标签,从而支持更准确的预测。

- 可扩展性:机器学习(machine learning, ML)需要大量数据,而这些数据往往因各种障碍或不可用性难以获取。合成数据生成提供了一种创造足够训练数据量的方法。

- 成本:商业实体通常提供高质量数据,但政府访问权可能代价高昂——尤其是当数据更专业且难以收集时。合成数据为数据提供了一种低成本来源,通常远比购买可直接使用的数据集便宜。\({ }^{149}\)

当前数据科学中有多种合成数据生成方法,其中三种最有潜力支持AI在参谋估计(staff estimates)与通用作战图(COP)中的应用:数据增强(data augmentation)、仿真(simulation)以及生成模型(generative models)。

数据增强(Data Augmentation)¶

数据增强是一种常见的合成数据生成技术,通过修改现有的真实数据来创建新数据。它通过多种变换方法来改变数据。例如,在图像处理中,数据科学家可以对同一张图像施加颜色变化、噪声、模糊、裁剪和旋转等不同程度的处理,从而生成新的训练数据集。\({ }^{150}\) 特别是在文本增强(text augmentation)方面,这是一种在AI模型训练中用于支持联合规划过程(Joint Planning Process, JPP)的强大工具。基础的文本增强技术包括同义词增强(synonym augmentation,即用同义词数据库中的单词替换原文中的随机单词)和词嵌入(word embedding,即用语义相近的单词替换原单词)。但近年来大型语言模型(Large Language Model, LLM)的进步使更高级的文本增强成为可能,如句子增强(sentence augmentation)。借助LLM,数据科学家可以从一句原始句子中生成多个不同表达但语义相同的句子。\({ }^{151}\)

仿真(Simulation)¶

仿真是另一种常见的合成数据生成方法,通过虚拟环境生成训练所需的数据集。它常用于机器人学中,用虚拟现实复制自主机器人的工作环境,通过多次仿真训练机器人应对不同情境。其优势在于可加速训练过程,速度远快于现实训练环境;同时还能处理极端或罕见情况。然而,其主要劣势在于仿真对真实世界行为的逼真度(保真度)较低。\({ }^{152}\)

仿真可成为在JPP中应用AI技术的有力工具。例如,基于AI驱动的风险生成模型的仿真系统可以通过模拟作战和环境变量来训练AI识别新的风险来源。但这种仿真代价高昂,因为仿真软件许可证价格昂贵,且越专业的许可证成本越高。此外,保真度越高所需的计算资源越多,从而增加计算与能源成本。例如,高保真仿真需要大量时间开发与定制,还需运行数百乃至上千次变体实验以生成可靠数据用于训练、测试与验证模型,这些都会消耗大量计算力和资金。

生成模型(Generative Models)¶

如前文所述,生成模型是由AI训练以创造新内容(通常为文本、声音、图像或视频)的模型。近期技术进步(如ChatGPT)使生成模型更加易用,并能生成高度逼真的内容。\({ }^{153}\) 若经过适当训练和测试,这类模型可生成用于联合规划过程(JPP)的合成产品,进一步输入至其他AI决策工具中。例如,人工生成的物流风险文本可用于训练识别关键指挥官信息需求(CCIR)的模型,其训练过程包括生成多种类型的物流风险文本、标注高风险项,并训练模型学习如何解释这些文本。

合成数据生成可成为陆军解锁AI模型训练数据潜力的关键技术。数据增强应作为首要投资方向,利用基础的数据增强技术生成更多JPP数据集。若陆军能成功训练LLM以生成JPP产品,生成模型也可能带来巨大收益。但由于成本高昂,不建议采用仿真法生成合成数据集。

数据标准化(Data Standardization)¶

相比合成数据,还有更直接的方式创建可用于AI模型训练的数据——即在整个机构内强制实施数据报告标准。最简单的方案是为参谋估计、通用作战图(COP)或CCIR建立数据结构标准。数据标准化若能得到机构的执行与维护,具有以下优势:

- 提升透明度与理解度:标准化促进数据含义的一致与清晰。

- 改善可访问性:统一的术语、代码与数据结构便于检索。

- 鼓励数据与软件的复用,实现多用途。

- 通过标准映射实现跨数据集比较,即便数据未完全标准化。

- 提供一致的数据检索结果。\({ }^{154}\)

如前所述,许多JPP产物是半结构化或非结构化格式,输入源既包括定量数据也包括定性数据。可通过以下两种方式实现标准化:(1)使用在输入阶段强制执行数据标准的JPP软件;(2)应用抽取、转换、加载(extract, transform, load, ETL)流程将现有数据重构为标准化格式。美国印太司令部(USINDOPACOM)的STORMBREAKER项目在这两方面均取得突破,其方法值得陆军借鉴。

标准化数据表单(Standardized Data Forms)¶

通过数据表单实施标准化的概念十分简单:应用程序为士兵提供在线表单填写界面,类似于电商网站的表单。表单包含JPP过程中必填与选填字段,并在保存前进行实时验证。此过程有两个优势:其一,制度流程易于执行,因为参谋部门必须遵循严格的数据录入流程并符合数据标准,否则验证阶段将拒绝提交;其二,数据科学家可确信从数据库提取的数据具备结构化和一定质量水平。

数据标准化需要治理机制(governance)以确保数据的安全性、隐私性、准确性、可用性与可用度。治理包括支持数据生命周期的行动、流程与技术。\({ }^{155}\) 国防部各机构通过治理机制管理对VAULTIS框架的合规,从而简化AI建模的数据收集与准备。但治理活动会增加参谋工作负担。要在全陆军范围推广JPP数据标准,需要作战司令部、联合参谋部及其他机构间的协调。标准变更需经过充分评估并获得各方一致同意。以下几点尤为重要:

- 软件工具的开发或采购需时间与资金。相较于使用Microsoft Word或PowerPoint制作的现有产品(如参谋估计),新软件成本更高,还需培训费用。推动DoD层面的统一软件工具可实现规模经济效应,并促进跨作战司令部的数据标准统一。

- 数据标准无法涵盖JPP所需的全部信息。例如,CCIR具有高度情境依赖性,突发行动无法等待标准更新。因此,新标准应考虑半结构化与非结构化数据字段。

- 综合利弊,陆军仍应推进JPP数据标准化建设。陆军应组建团队研究JPP在不同作战司令部的应用,并依据以下指南制定数据标准,以便从单位自定义产品平滑过渡到标准化、结构化、可机器读取的数据产品,减少数据收集与准备步骤,加快项目周期。

数据漂移(Data Drift)¶

有效的数据管理需防止、检测并应对数据漂移(data drift)。数据漂移指输入数据的统计特性随时间变化,导致模型性能下降。当训练数据与输入数据分布不符时,预测结果会变得不可靠。数据漂移分为协变量漂移(covariate drift,又称特征漂移feature drift)与概念漂移(concept drift)。协变量漂移是指训练数据集中自变量分布的变化不再匹配实际环境分布,例如光照变化会影响图像数据,从而降低图像检测模型的准确性。概念漂移指目标特征本身随时间变化,使模型试图预测的概念发生偏移。例如,当垃圾邮件内容不断模仿正常邮件时,AI垃圾邮件检测模型可能失效。\({ }^{156}\)

对于判别系统,管理漂移需监控其精确率(precision)与召回率(recall)。精确率表示预测为正样本中真正为正的比例,例如AI目标识别系统检测区域内所有坦克,但若其也将火炮识别为坦克,则精确率不高。召回率则表示所有真实正样本中被正确预测的比例。例如检测出10辆坦克中的8辆,则召回率为80%。最终系统得分(F1 score)计算公式为 \(2 * (precision * recall) / (precision + recall)\),用于平衡两者关系。\({ }^{157}\)

算法偏差(Algorithmic Bias)¶

AI模型的结果可能受数据集准备与算法训练方式影响而存在偏差。\({ }^{158}\) 若数据集不具代表性,则模型可能生成偏颇的结果。例如,实际数据分布与训练数据不同,模型将无法准确反映现实。\({ }^{159}\) 这种偏差在军事与执法领域尤为严重,因为词语、图像等符号的语义可能与通用数据库不同。例如,若某LLM主要接受商业策略类提示(prompt)训练,则军事用户得到的输出中可能充斥商业术语。改进此问题需从零构建或再训练模型。

在生成式AI中,输入提示的质量亦影响输出结果。提示信息越丰富,模型越能准确捕捉词语间关系。结构化输入对于模型正确理解输入至关重要。此外,由于模型基于概率关系生成内容,常出现“幻觉”(hallucination)——即生成错误或虚构信息。2023年发表于《自然语言处理期刊》(Natural Language Processing Journal)的一项研究指出,九种主流LLM生成的文本中,约46.4%存在事实错误,52.0%存在语义矛盾,31.3%包含逻辑谬误。\({ }^{160}\)

通过严格定义、反映JPP需求的数据标准可有效缓解上述问题。为此,需要研究多个作战司令部的数据结构并统一标准,从而将单位自定义产品转化为标准化、结构化、可机器读取的数据,减少数据收集与准备环节,缩短项目周期。陆军可采取以下措施:

- 聚焦于信息需求(IR)的局部数据标准,而非全局JPP模板。每个参谋部门的IR应有针对性标准。例如维护估计应统一设备完好率数据格式。

- 采用“最小公分母”方法(lowest common denominator)创建数据标准,即选取被最多用户共享的数据类型,如天气风险数据。

- 包含支持半结构化与非结构化数据的灵活字段。例如STORMBREAKER的“附加说明”字段允许自由文本输入,或文件附件字段用于上传图像、视频、PDF等。

- 按“数据即产品”(data-as-a-product)原则和数据网格(data mesh)架构设计数据标准,确保数据质量、可用性与生命周期管理,明确数据所有权与治理,使领域专家能够主导数据管理。\({ }^{161}\)

- 在模型训练中使用ETL方法,将多源数据整合为统一仓库,通过规则清洗、组织与准备用于AI与ML训练。\({ }^{162}\) 其三步为:

- 提取源数据库的相关数据;

- 转换数据以便分析;

- 加载至目标数据库。

ETL技术可将存档报告与文档转化为标准化格式供AI训练使用。结合数据网格原则,ETL成为创建符合VAULTIS标准的数据产品的强大工具。

陆军可利用DoD主数据分析平台Advana提供的标准ETL流程。\({ }^{163}\) 例如,为JPP生成作战COP数据的ETL管线可在不同陆军司令部(如USARCENT与USARPAC)间复用,只需调整数据源位置。标准化ETL管线的可行性研究应聚焦以下问题:

- JPP最常用的数据源是什么?

- 哪些政策障碍阻止Advana等平台访问作战数据?

- JPP数据标准化最常用的转换工具是什么?

- 是否存在可将非结构化/半结构化数据转换为结构化数据的工具(如Unstructured.io for LLM)?\({ }^{164}\) 平台是否支持灵活添加新工具?

结论¶

目前,AI与ML更适合用于加速和优化支撑COP的辅助功能(如情报生成、参谋估计及预测整合),而非直接生成COP本身。由于军事特定数据需求量巨大、模型需专门训练、计算资源消耗高且战场环境变化快,AI与ML无法在无人干预下制定行动方针(COA)或撰写作战命令。然而,AI与ML可协助人类完成规划中的科学部分,让人类专注于战略艺术。AI应被视为工具而非目的,用于增强人类能力——无论是数字助理、机器人伙伴还是其他自动化工具。\({ }^{165}\)

为优化现有技术,国防部应聚焦开发与应用小型AI/ML模型,以提升辅助规划功能,从而加快信息流转与决策速度。未来,或可出现“虚拟指挥官”(virtual commander),整合多模型输出与实时信息,生成COP、制定与评估COA、估算成功与风险,并由人类指挥官做最终决策。正如艾森豪威尔所言:“计划本身毫无价值,但规划过程至关重要。”\({ }^{166}\) 鉴于规划对人类的重要性,将部分规划任务留给指挥官与参谋永远合理。

理想状态下,机构应能方便地获取经过准备的数据用于模型训练。若国防部的数据、分析与AI采纳战略得到成功实施,并结合上述建议,未来AI项目的启动流程或将如下:数据科学家确定一个与JPP相关、适合AI解决的问题,并明确模型所需数据;通过数据网格目录查找并获取标准化的参谋估计、IR、CCIR与COP数据产品;随后使用数据遮蔽与脱密技术准备训练数据,必要时利用合成数据补充数据量。完成加速的数据收集与准备后,项目即可专注于模型训练与验证阶段。

国防部与陆军目前仍处于AI制度化支持JPP的早期阶段。然而,陆军正处于建立以数据为中心的作战规划文化的关键节点。通过构建作战数据网格、标准化作战数据、投资合成数据生成与实施数据脱密政策,陆军将显著降低AI模型开发的门槛。解锁作战数据是陆军迈向AI成功采纳的关键一步。

注释¶

- Headquarters, Department of the Army (HQDA), The Operations Process, Army Doctrine Publication 5-0 (HQDA, 2019), 2-1.

- Trevor Dupuy, Numbers, Predictions, and War: Using History to Evaluate Combat Factors and Predict the Outcome of Battles (The Bobbs-Merrill Company, 1979), 43-45.

- HQDA, Operations Process, 2-2.

- Joint Chiefs of Staff (JCS), Joint Planning, Joint Publication 5-0 (JCS, 2024), xix.

- JCS, Joint Planning, xii.

- JCS, Joint Planning, IV-1-46.

- JCS, Joint Planning, III-1-78.

- HQDA, Operations Process, 2-8.

- HQDA, Army Design Methodology, Army Techniques Publication 5-0.1 (HQDA, July 2015); and HQDA, "The Military Decision-Making Process," in Planning and Orders Production, Field Manual 5-0 (HQDA, 2022), 5-1-5-60.

- HQDA, Operations Process, 2-9.

- HQDA, "Planning," in Operations Process, 2-1-26.

- HQDA, "Fundamentals of the Operations Process," in Operations Process, 1-4-18.

- HQDA, Mission Command: Command and Control of the Armed Forces, Army Doctrine Publication 6-0 (HQDA, 2019), 2-3.

- HQDA, Mission Command, 2-3-4; and HQDA, Intelligence Preparation of the Battlefield, Army Techniques Publication 2-01.3 (HQDA, March 2019), 1-2-3.

- JCS, Joint Campaigns and Operations, Joint Publication 3-0 (JCS, 2022), GL-8.

- HQDA, Mission Command, 3-15-16; and "What Is a Single Pane of Glass," IBM, accessed January 8, 2025, https://www.ibm.com/think/topics/single-pane-of-glass.

- HQDA, Commander and Staff Organization and Operations, Field Manual 6-0 (HQDA, 2022), 6-7-8.

- Joint Staff J7, Insights and Best Practices, 3rd ed. (Joint Staff J7, May 2018), 12.

- HQDA, Commander and Staff, 6-7-8.

- Joint Staff J-7, Insights and Best Practices, 12.

- HQDA, Planning and Orders Production, C-1-4.

- HQDA, Mission Command, 3-6-7, 4-10.

- HQDA, Planning and Orders Production, 4-4-5.

- HQDA, Planning and Orders Production, 4-1.

- HQDA, Planning and Orders Production, 4-1.

- HQDA, Planning and Orders Production, 5-23-33.

- HQDA, Planning and Orders Production, 5-33-60.

- Robert O. Work, memorandum, "Establishment of an Algorithmic Warfare Cross-Functional Team (Project Maven)," April 26, 2017, Washington, DC.

- Edward Moore Geist, "It's Already Too Late to Stop the AI Arms Race-We Must Manage It Instead," Bulletin of the Atomic Scientists 72, no. 5 (2016): 318.

- Sara R. Hedberg, "DART: Revolutionizing Logistics Planning," Institute of Electrical and Electronics Engineers Intelligent Systems (May/June 2002): 81.

- Hedberg, "DART," 1.

- IBM Data and Artificial Intelligence Team, "AI vs. Machine Learning vs. Deep Learning vs. Neural Networks: What's the Difference?," IBM, July 6, 2023, https://www.ibm.com/think/topics /ai-vs-machine-learning-vs-deep-learning-vs-neural-networks.

- Iván Contreras and Josep Vehí, "Artificial Intelligence for Diabetes Management and Decision Support: Literature Review," Journal of Medical Internet Research 20, no. 5 (2018): 5.

- Ivan Belcic and Cole Stryker, "What Is Supervised Learning?," IBM, n.d., accessed January 8, 2025, https://www.ibm.com/think/topics/supervised-learning.

- Apoorv Agarwal, "Demystifying AI: What Is Unsupervised Learning?," Relativity (blog), September 29, 2021, https://www.relativity.com/blog/demystifying-ai-what-is-unsupervised-learning/.

- IBM Data and Artificial Intelligence Team, "Understanding the Different Types of Artificial Intelligence," IBM, October 12, 2023, https://www.ibm.com/think/topics/artificial-intelligence-types.

- Chethan Kumar GN, "Artificial Intelligence: Definition, Types, Examples, Technologies," Medium, August 31, 2018, https://chethankumargn.medium.com/artificial-intelligence-definition -types-examples-technologies-962ea75c7b9b.

- Huma Sheikh et al., "Artificial Intelligence: Definition and Background," in Mission AI: Research for Policy (Springer, 2023), 39.

- Timothy B. Lee and Sean Trott, "A Jargon-Free Explanation of How AI Large Language Models Work," Ars Technica, July 31, 2023, https://arstechnica.com/science/2023/07/a-jargon-free -explanation-of-how-ai-large-language-models-work/.

- Annamalai Chockalingam et al., A Beginner's Guide to Large Language Models Part 1 (NVIDIA, 2023); and Nicholas Cropp, "So What's the Difference between AI, GAI, ML, LLM, GANs, GPTs?," LinkedIn, May 20, 2023, https://www.linkedin.com/pulse/so-whats-difference-between-ai -gai-ml-11m-gans-gpts-nicholas-cropp.

- Henrik Kniberg, Generative AI in a Nutshell - How to Survive and Thrive in the Age of AI (Henrik Kniberg, 2024), YouTube video, https://www.youtube.com/watch?v=2IK3DFHRFfw.

- Celeste Biever, "ChatGPT Broke the Turing Test-The Race Is on for New Ways to Assess AI," Nature 619, no. 7971 (July 2023): 686-89.

- Jason Wei et al., "Emergent Abilities of Large Language Models," Transactions on Machine Learning Research (August 2022): 2.

- Rylan Schaeffer et al., "Are Emergent Abilities of Large Language Models a Mirage?," unpublished manuscript, May 22, 2023.

- 3Blue1Brown, Transformers (How LLMs Work) Explained Visually \(\mid\) DL5 (3Blue1Brown, April 1, 2024), YouTube video, https://www.youtube.com/watch?v=wjZofJX0v4M.

- Lee and Trott, "Jargon-Free Explanation."

- Lee and Trott, "Jargon-Free Explanation."

- Grant Sanderson, "But What Is a GPT? A Visual Introduction to Transformers," 3Blue1Brown Mailing List (blog), April 1, 2024, https://3blue1brown.substack.com/p/but-what-is-a-gpt.

- Lee and Trott, "Jargon-Free Explanation."

- Karen Hao, "This Is How AI Bias Really Happens-and Why It's So Hard to Fix," MIT Technology Review, February 4, 2019, https://www.technologyreview.com/2019/02/04/137602/this-is-how-ai-bias -really-happensand-why-its-so-hard-to-fix/.

- Adrian de Wynter et al., "An Evaluation on Large Language Model Outputs: Discourse and Memorization," Natural Language Processing Journal 4 (September 2023): 1.

- Sara Brown, "Machine Learning, Explained," Massachusetts Institute of Technology, April 21, 2021, https://mitsloan.mit.edu/ideas-made-to-matter/machine-learning-explained.

- Jacob Murel and Eda Kavlakoglu, "What Is Feature Engineering?," IBM, January 20, 2024, https://www.ibm.com/topics/feature-engineering.

- "Data Products: The Foundation for Data Mesh," k2View, June 18, 2024, https://www.k2view .com/what-is-a-data-product/.

- HQDA, Planning and Order Production, C-1.

- Joint Staff J-7, Insights and Best Practices, 12.

- HQDA, Mission Command, 3-15.

- HQDA, Mission Command, 3-15.

- Kristine Steen-Tveit and Bjorn Erik Munkvold, "From Common Operational Picture to Common Situational Understanding: An Analysis Based on Practitioner Perspectives," Safety Science 142 (October 2021).

- HQDA, Mission Command, 2-3-4.

- HQDA, Mission Command, 2-3-4.

- Kevin Hanegan, "Harnessing the AI-Powered Data Lifecycle," Turning Data into Wisdom, October 25, 2023, https://www.turningdataintowisdom.com/ai-powered-data-lifecycle/.

- Eric Colson, "What AI-Driven Decision Making Looks Like," Harvard Business Review, July 8, 2019, https://hbr.org/2019/07/what-ai-driven-decision-making-looks-like.

- "Quantitative vs. Qualitative Data," Rudderstack, n.d., accessed June 30, 2024, https://www .rudderstack.com/learn/data-analytics/quantitative-vs-qualitative-data/; and "What Is Natural Language Processing (NLP)?," Amazon Web Services, n.d., accessed June 30, 2024, https://aws.amazon.com /what-is/nlp/.

- "Analyzing Text Data," George Washington University Libraries, July 10, 2024, https://libguides .gwu.edu/textanalysis/methods; and Liana Teixeira, "Exploring the Depths of Qualitative and Quantitative Data Analysis," LinkedIn, January 25, 2024, https://www.linkedin.com/pulse/exploring -depths-qualitative-quantitative-data-liana-ahrens-teixeira-j61mf/.

- Cory Cannon, e-mail message to author, February 7, 2024.

- HQDA, Mission Command, 3-16; and Joint Staff J-7, Insights and Best Practices.

- HQDA, Mission Command, 3-7-8.

- JaiminDave, "A Step by Step Guide to AI Model Development," Data Science Central, September 7, 2021, https://www.datasciencecentral.com/a-step-by-step-guide-to-ai-model-development/.

- HQDA, Planning and Orders Production, C-1.

- Danielle Kress, "Army Seeks Industry Input on Approach to Modernizing Digital Fires Products," U.S. Army, November 1, 2023, https://www.army.mil/article/271343/army_seeks_industry_input_on _approach_to_modernizing_digital_fires_products.

- "Global Command \& Control System-Joint," Office of the Director, Operational Test and Evaluation, 2023, https://www.dote.osd.mil/Portals/97/pub/reports/FY2023/dod/2023gccs-j. pdf?ver=JHN4Z-fuq-PbH6UPVAgyKA\%3d\%3d.

- Department of Defense (DoD), Department of Defense Data, Analytics, and Artificial Intelligence Adoption Strategy: Accelerating Decision Advantage (DoD, November 2023), 21-22.

- WhatIs, s.v. "metadata," n.d., accessed June 30, 2024, https://www.techtarget.com/whatis/definition /metadata.

- United States Indo-Pacific Command (USINDOPACOM) J5, "J5 STORMBREAKER Joint Operational PLANNING Toolkit (JOPT)" (PowerPoint presentation, USINDOPACOM, Carlisle, PA, November 2, 2023); and United States Forces Korea, UCJ Digital Planning Tools (DPT) Status (United States Forces Korea, January 3, 2024).

- AcqNotes, s.v. "security classification guide (SCG)," updated October 3, 2023, https://acqnotes .com/acqnote/careerfields/security-classification-guide.

- DoD, DoD Information Security Program: Marking of Information, DoD Manual 5200.01 (DoD, 2020), 2:27, 2:40-41.

- Ronald S. Moultrie, memorandum, "Fiscal Year 2022 Fundamental Classification Guidance Review," December 6, 2022, Washington, DC.

- DoD Inspector General, Audit of Governance and Protection of Department of Defense Artificial Intelligence Data and Technology, Report no. DODIG-2020-098 (DoD Inspector General, June 2020), 10-11.

- Moultrie, "Fundamental Classification Guidance Review."

- "What Is Structured Data?," Amazon Web Services, n.d., accessed June 30, 2024, https://aws .amazon.com/what-is/structured-data/.

- "Unstructured Data," MongoDB, n.d., accessed June 30, 2024, https://www.mongodb.com /unstructured-data.

- "Structured vs. Unstructured Data," H2O.Ai, n.d., accessed June 30, 2024, https://h2o.ai/wiki /structured-vs-unstructured-data/.

- "What Is Data Labeling?," Amazon Web Services, n.d., accessed June 30, 2024, https://aws .amazon.com/what-is/data-labeling/.

- Jon Ludwigson and Candice N. Wright, Artificial Intelligence: Status of Developing and Acquiring Capabilities for Weapon Systems, GAO-22-104765 (Government Accountability Office, February 2022).

- DoD, Summary of the Joint All-Domain Command \& Control (JADC2) Strategy (DoD, March 2022), 3.

- DoD, Summary, 5.

- Moultrie, "Fundamental Classification Guidance Review."

- Moultrie, "Fundamental Classification Guidance Review."

- Jacqueline Coffman, "AI2C Overview with DOD Cyber Workforce Framework" (PowerPoint presentation, US Army Artificial Intelligence Integration Center, Pittsburgh, PA, January 4, 2024).

- "Joint Battle Command Platform," Program Executive Office Command Control CommunicationsTactical, n.d., accessed June 30, 2024, https://peoc3t.army.mil/Organizations/PM-Mission-Command /Joint-Battle-Command-Platform/ (page discontinued).

- HQDA, Intelligence, Field Manual 2-0 (HQDA, 2023), 5-24-27.

- HQDA, Intelligence, 8-34.

- Saleha Mohsin, "Inside Project Maven, the US Military's AI Project," Bloomberg, February 29, 2024, https://www.bloomberg.com/features/2024-ai-warfare-project-maven/.

- Mohsin, "Inside Project Maven."

- Kevin Hartford, interview by the author, March 15, 2024.

- Joseph O'Callaghan, "Maven Smart Systems and JADC2 Overview" (speech, XVIII Airborne Corps Annual Scarlett Dragon Exercise, Fort Liberty, NC, December 4-7, 2023).

- Hartford, interview by the author.

- Mohsin, "Inside Project Maven."

- Mohsin, "Inside Project Maven."

- O'Callaghan, "Maven Smart Systems."

- Forrest E. Morgan et al., Military Applications of Artificial Intelligence: Ethical Concerns in an Uncertain World (RAND Corporation, 2020), 17.

- Tiffany Yeung, "What Is Edge AI and How Does It Work?," NVIDIA Blog, February 17, 2022, https://blogs.nvidia.com/blog/what-is-edge-ai/.

- HQDA, Planning and Orders Production, 5-7.

- Ferenc Fazekas, "AI and Military Operations' Planning," in Artificial Intelligence and Its Contexts, ed. Anna Visvizi and Malgorzata Bodziany (Springer, 2021), 79-91.

- HQDA, Planning and Orders Production, 5-23-29.

- Adam J. Kurzen, "J5 STORMBREAKER Joint Operational PLANNING Toolkit (JOPT)" (PowerPoint presentation, USINDOPACOM, Carlisle, PA, October 18, 2023).

- Kurzen, "Joint Operational PLANNING Toolkit."

- Kurzen, "Joint Operational PLANNING Toolkit."

- Laura Heckmann, "Indo-Pacific Command to Harness AI for Operational Planning," National Defense Magazine, March 25, 2024, https://www.nationaldefensemagazine.org/articles /2024/3/25/indo-pacific-command-to-harness-ai--for-operational-planning.

- USINDOPACOM G5 personnel, interview by the author, November 13, 2023.

- Peter Schwartz et al., "AI-Enabled War-Gaming in the Military Decision-Making Process," Proceedings of the SPIE 11413 (April 2020).

- Vinicius G. Goecks and Nicholas Waytowich, \(C O A-G P T\) : Generative Pre-Trained Transformers for Accelerated Course of Action Development in Military Operations (arXiv, March 2024), 3.

- Vinicius G. Goecks and Nicholas R. Waytowich, "DisasterResponseGPT: Large Language Models for Accelerated Plan of Action Development in Disaster Response Scenarios," unpublished manuscript, June 29, 2023, 1.

- Guanzhi Wang et al., "Voyager: An Open-Ended Embodied Agent with Large Language Models," unpublished manuscript, May 25, 2023, 1.

- Shalev Lifshitz et al., "Steve-1: A Generative Model for Text-to-Behavior in Minecraft," unpublished manuscript, June 1, 2023, 1.

- Goecks and Waytowich, \(C O A-G P T, 1-3\).

- Priya Narayanan et al., First-Year Report of ARL Director's Strategic Initiative (FY20-23): Artificial Intelligence (AI) for Command and Control (C2) of Multi Domain Operations (US Army Development Command Army Research Laboratory, May 2021), 7.

- Narayanan, First-Year Report, 6.

- Nicholas Waytowich et al., "Learning to Guide Multiple Heterogeneous Actors from a Single Human Demonstration via Automatic Curriculum Learning in Starcraft II," Artificial Intelligence and Machine Learning for Multi-Domain Operations Applications IV 12113 (June 2022): 5; Volodymyr Mnih et al., "Asynchronous Methods for Deep Reinforcement Learning," Proceedings of the 33rd International Conference on Machine Learning 48 (June 2016): 4; and Goecks and Waytowich, COA-GPT, 6.

- Goecks and Waytowich, \(C O A-G P T, 5-6\).

- Goecks and Waytowich, \(C O A-G P T\), 6.

- Goecks and Waytowich, \(C O A-G P T, 2-8\).

- Kimberly Sablon, "Disruptive Technologies and the Changing Character of War: Artificial Intelligence" (PowerPoint presentation, Future Operating Environment Professional Military Education Faculty Workshop Series, National Defense University, Washington, DC, February 21, 2024).

- DoD, Artificial Intelligence Adoption Strategy, 12.

- David Bray, "Why Trust Matters in AI? How Can We Achieve It?" (PowerPoint presentation, Strategic Multilayer Assessment General Speaker Session, Stimson Center, Washington, DC, October 5, 2023).

- Ron Wasserstein, "George Box: A Model Statistician," Significance 7, no. 3 (September 2010): 134.

- "Enterprise Data Mesh: What Is Data Mesh?," Oracle, n.d., accessed June 30, 2024, https:// www.oracle.com/integration/what-is-data-mesh/.

- "What Is Data Obfuscation?," Informatica, n.d., accessed June 30, 2024, https://www.informatica .com/services-and-training/glossary-of-terms/data-obfuscation-definition.html.

- "What Is a Data Mesh?," IBM, n.d., accessed June 30, 2024, https://www.ibm.com/topics /data-mesh.

- Vijay K Butte and Sujata Butte, Enterprise Data Strategy: A Decentralized Data Mesh Approach (Institute of Electrical and Electronics Engineers, October 2022).

- "What Is a Data Mesh?"

- Lisbeth Perez, "DoD CDAO Seeks Commercial Data-Mesh Capabilities," MeriTalk, October 30, 2023, https://www.meritalk.com/articles/dod-cdao-seeks-commercial-data-mesh -capabilities/.

- Anastasia Obis, "Army Implementing New Data Architecture, Launching Innovation Exchange Lab Next Month," Federal News Network, January 16, 2024, https://federalnewsnetwork.com/army/2024/01 /army-implementing-new-data-architecture-launching-innovation-exchange-lab-next-month/.

- Alfred Hull, "Data - the Key to Modernization" (PowerPoint presentation, 2022 Association of the US Army National Conference, Washington, DC, October 11, 2022), https://api.army.mil/e2/c /downloads/2022/11/02/fdfd99c2/b3-data-the-key-to-modernization-panel.pdf.

- C. Todd Lopez, "DOD Adopts 5 Principles of Artificial Intelligence Ethics," DOD News, February 25, 2020, https://www.defense.gov/News/News-Stories/article/article/2094085/dod-adopts -5-principles-of-artificial-intelligence-ethics/.

- Tim Osborn, "Data Mesh vs. Data Lake: Pros, Cons, \& How to Decide," Monte Carlo Data, June 23, 2023, https://www.montecarlodata.com/blog-data-mesh-vs-data-lake-whats-the-difference/.

- Henrik Skogström, "When Should a Machine Learning Model Be Retrained?," Valohai, November 30, 2020, https://valohai.com/blog/when-should-a-machine-learning-model-be-retrained/.

- Krissanawat Kaewsanmua, "Data Labeling Software: Best Tools for Data Labeling," Neptune Blog, August 22, 2023, https://neptune.ai/blog/data-labeling-software.

- "What Is Data Masking?," Amazon Web Services, n.d., accessed June 30, 2024, https://aws .amazon.com/what-is/data-masking/.

- Karen Jain, "Data Anonymization and Data Masking in Healthcare," Medium, October 30, 2023, https://karen-j.medium.com/data-anonymization-and-data-masking-in-healthcare-db2650f04213.

- Moultrie, "Fundamental Classification Guidance Review."

- Hui Yang et al., Research on Intelligent Security Protection of Privacy Data in Government Cyberspace (Institute of Electrical and Electronics Engineers, April 2020).

- "What Is Emergent Behavior in AI?," TedAI, n.d., accessed June 30, 2024, https://www.ai-event .ted.com/glossary/emergent-behavior.

- Stephen Ornes, "The Unpredictable Abilities Emerging from Large AI Models," Quanta Magazine, March 16, 2023, https://www.quantamagazine.org/the-unpredictable-abilities-emerging-from-large -ai-models-20230316/.

- "What Is Synthetic Data?," IBM, n.d., accessed June 30, 2024, https://research.ibm.com/blog /what-is-synthetic-data.

- "What Is Synthetic Data?," Mostly AI, n.d., accessed June 30, 2024, https://mostly.ai/synthetic -data/what-is-synthetic-data.

- Rob Toews, "Synthetic Data Is about to Transform Artificial Intelligence," Forbes, June 12, 2022, https://www.forbes.com/sites/robtoews/2022/06/12/synthetic-data-is-about-to-transform-artificial -intelligence.

- Andrew M. Dai et al., "Best Practices and Lessons Learned on Synthetic Data," paper presented at the Conference on Language Modeling 2024, October 7, 2024; and "Synthetic Data Generation: A Comprehensive Guide," Let's Data Science, February 10, 2024, https://letsdatascience.com/synthetic -data-generation/.

- Linus Luotsinen et al., Deep Learning with Limited Data: A Synthetic Approach (Swedish Defence Research Agency, December 2021).

- Haixing Dai et al., AugGPT: Leveraging ChatGPT for Text Data Augmentation (ArXiv, March 2023).

- Luotsinen et al., Deep Learning.

- Sophia Khatsenkova, "ChatGPT: Is It Possible to Detect AI-Generated Text?," EuroNews, January 19, 2023, https://www.euronews.com/next/2023/01/19/chatgpt-is-it-possible-to-detect-ai -generated-text.

- "Learn about Data Standards," Environmental Protection Agency, October 10, 2023, https:// www.epa.gov/data/learn-about-data-standards.

- "What Is Data Governance?," Google Cloud, n.d., accessed June 30, 2024, https://cloud.google .com/learn/what-is-data-governance.

- Hemant Rawat, "Detecting Data Drift in Machine Learning," Medium, February 11, 2024, https://hemantra.medium.com/detecting-data-drift-in-machine-learning-8ebb6212b034; and Chris Lowrance, e-mail message to author, October 25, 2024.

- Stephen M. Walker II, "F-Score: What Are Accuracy, Precision, Recall, and F1 Score?," KLU, n.d., accessed November 5, 2024, https://klu.ai/glossary/accuracy-precision-recall-f1; and "F1 Score in Machine Learning," Deepgram, June 18, 2024, https://deepgram.com/ai-glossary/f1-score-machine -learning.

- Hao, "AI Bias."

- Lowrance, e-mail message to author.

- Adrian de Wynter et al., "An Evaluation on Large Language Model Outputs: Discourse and Memorization," Natural Language Processing Journal 4 (September 2023): 1.

- Jan Bode et al., "Towards Avoiding the Data Mess: Industry Insights from Data Mesh Implementations," Journal of the Association for Computing Machinery 37, no. 4 (August 2024).

- "What Is ETL (Extract Transform Load)?," Amazon Web Services, n.d., accessed June 30, 2024, https://aws.amazon.com/what-is/et1/; and "What Is ETL (Extract Transform Load)?," Informatica, n.d., accessed June 30, 2024, https://www.informatica.com/tw/resources/articles/what-is-etl.html.

- "Data Analytics," Office of the Assistant Secretary of Defense for Acquisition, n.d., accessed June 30, 2024, https://www.acq.osd.mil/asda/dpc/api/data-analytics.html.

- Kyle Wiggers, "Unstructured, Which Offers Tools to Prep Enterprise Data for LLMs, Raises $25M," TechCrunch, July 19, 2023, https://techcrunch.com/2023/07/19/unstructured-which -offers-tools-to-prep-enterprise-data-for-llms-raises- \(25 \mathrm{~m} /\).

- Mark Pomerleau, "Army S\&T Advisor Flags 'Misconceptions' about Artificial Intelligence," DefenseScoop, August 1, 2023, https://defensescoop.com/2023/08/01/army-st-advisor-flags -misconceptions-about-artificial-intelligence.

- HQDA, Operations Process, 2-3.

2. 将AI融入联合规划过程(Joint Planning Process, JPP)的组织适应¶

引言¶

管理与整合新兴技术是各国军队面临的共同挑战。虽然资源配置决策提供了变革的“手段”,但组织调整则提供了实现变革的“途径”,构建了整合的框架。新技术的潜在颠覆性决定了所需组织调整的类型,因为某些创新的影响较为直接,而其他则更为复杂。将新兴技术融入组织体系需以审慎的组织设计(organizational design)原则为基础,即“为实现组织目标而创造、修改和/或消除角色、流程与结构”。\({ }^{1}\)

美国陆军未来的组织设计中,一个重要的考量是机器智能(machine intelligence)与人类专长的结合——制度化人工智能能力,以增强态势感知(situational awareness)、行动方案(COA)制定与规划效率,从而简化领导者的决策过程。

然而,陆军在组织上适应AI技术必然会遇到摩擦。陆军是一个官僚体系,天生抗拒变革且深植传统。取消岗位、调整结构或重组流程都会挑战既有的运作方式,并可能削弱组织内部分领导的地位。更复杂的是,设立新岗位并投入资金、时间和人力都存在机会成本。例如,数周或数月的AI培训意味着士兵脱离部队准备时间,或放弃其他训练机会。为了克服变革阻力并有效整合AI,陆军可以评估当前部队结构与组织设计,识别可从旧有架构中撤出资源的领域,并在各级梯队中投资新的力量结构与设计。此外,陆军可通过既有流程为AI赋能的人员建立可持续职业路径,并阐明这些组织变革的预期价值。

将AI作为规划工具整合进组织,需要新机构有效管理资源、协调训练并将实战经验固化为最佳实践。为避免资源浪费和重复投入,新机构必须明确所需的新技能、培训对象、可借助民间力量的资源来源,以及调整人员配置的潜在意外后果。

本章探讨在以人机协同(Human-Machine Teaming, HMT)为核心的规划工具中整合AI的组织层面问题。首先从陆军的战略层面审视通过持续训练与实验所形成的AI战略文件,最后分析这类新技术可能对人员结构带来的意外影响。

陆军层面的AI整合与培训¶

2018年,陆军成立了陆军人工智能工作组(Army Artificial Intelligence Task Force),隶属于美国陆军未来司令部(US Army Futures Command),直接向陆军参谋长汇报。\({ }^{2}\)

随后,陆军认识到需要新的指挥机构来管理先进技术能力的开发与维持,于是正式组建了未来司令部,使其成为负责力量设计与发展的主导机构,塑造未来陆军。\({ }^{3}\)

未来司令部设立了多个跨职能团队(cross-functional teams, CFTs),以应对技术创新中的缺口,确保陆军各项目的现代化工作可互操作,并降低陆地领域的风险。\({ }^{4}\)

2020年,国防部发布《人工智能教育战略》(Artificial Intelligence Education Strategy),目标是在2035年前打造一支AI赋能的劳动力队伍。为实现此目标,战略规划了四条主线任务、可量化的行动与投资,以确保国防部具备能够在大规模AI平台(包括大型语言模型)环境中灵活运作的专业人员。该战略的核心内容包括:加速AI技术在军队体系中的整合与创新、培养AI技能型人才,以及保持美国在AI领域的领导地位以确保国家安全。\({ }^{5}\)

同年,未来司令部将人工智能工作组重组为陆军人工智能整合中心(Army Artificial Intelligence Integration Center, AI2C)。该机构负责领导陆军的AI现代化进程,推动AI工具的协作应用,构建大规模数据驱动平台,并开发教育项目以建立AI教育管道,为全军不同层级的人员提供培训。\({ }^{6}\)

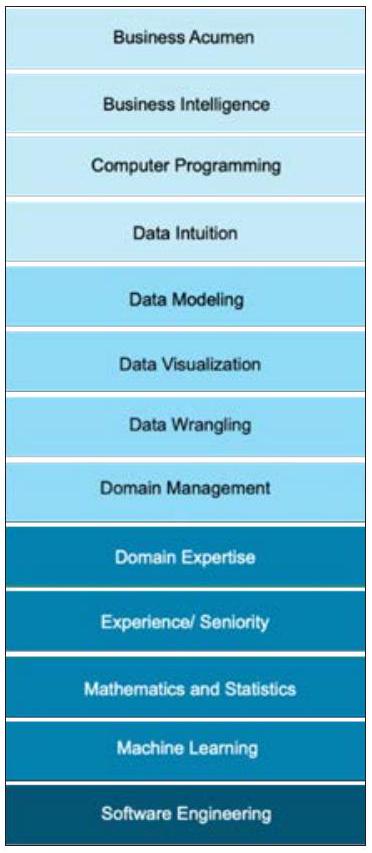

AI2C与卡内基梅隆大学(Carnegie Mellon University, CMU)合作,建立了正式的教育路径,旨在弥补人才管理缺口,并制定全面的劳动力发展计划,以快速且规模化地为全军提供AI解决方案。借助此合作,AI2C开发了如图2-1所示的人才发展框架。\({ }^{7}\)

该框架涵盖军队与文职体系的多个领导层级,其培训项目已培养约729名陆军人员,从高级领导到AI用户。

图2-1. AI2C劳动力发展框架(work-force development framework)

美国陆军人力资源司令部(US Army Human Resources Command)管理高级平民教育项目(Advanced Civil Schooling Program),俗称“人工智能学者计划”(Artificial Intelligence Scholars Program, AISP)。该计划为士兵提供研究生教育机会,专业方向包括计算数据科学(computational data science)、AI工程(AI engineering)、数据工程(data engineering)或商业智能与数据分析(business intelligence data analytics),并由卡内基梅隆大学授予学位。该项目迄今已培养约81名陆军毕业生,学制四年。毕业后,学员需在陆军未来司令部的软件工厂(Army Software Factory)进行两年岗位实践。2024年,陆军将威斯康星大学麦迪逊分校(University of Wisconsin–Madison)纳入AISP体系,派遣两名学生攻读数据工程硕士学位,以支持陆军AI能力建设。\({ }^{8}\)

目前的人工智能技师计划(Artificial Intelligence Technician Program)为期三年,其中一年学习,另两年为培训与认证阶段,完成后方被视为具备完全资格。\({ }^{9}\)

然而,研究者指出,目前在保障参与AI路径人员的职业竞争力方面仍存在空白:尚未建立可持续的职业路径,也未在作战单位中创建支撑AI士兵教育与实习需求的力量结构或组织设计。

陆军人工智能整合中心项目经理Michael Meneghini在采访中指出,该中心通过外联与培训满足陆军的近期与未来需求。该培训被称为“学徒计划”(apprenticeship program),旨在培养士兵具备内部开发AI能力的技能。培训目标包括从算法与代码编写等技术知识,到预算与采购流程的入门。其目的是使陆军人员能够以执行者、规划者或项目经理的身份开展AI工作。\({ }^{10}\)

若要在2035年前形成AI赋能的劳动力队伍,陆军必须为这类稀缺的AI专业人才建立可持续的职业路径。作为积极举措,陆军在2021年批准了五个新的技能标识符(additional skill identifiers, ASI),以弥补AI人才体系的缺口:\({ }^{11}\)

- 人工智能数据工程师(Artificial Intelligence Data Engineer, D3):需完成AISP并专攻计算机科学,获得计算数据科学硕士学位。

- 人工智能数据分析师(Artificial Intelligence Data Analyst, D4):需完成AISP并专攻数据分析,获得信息系统管理与商业智能数据分析硕士学位。